据https://t.co/St5O59mmxt分析,Meta决定不在欧盟发布其多模态AI产品和模型,主要原因是欧盟的监管环境太“捉摸不定”,简直像是在玩捉迷藏。

这意味着,欧洲的Ray-Ban Meta用户将无法使用图像理解功能,真是“眼镜”带来了眼泪。此外,欧盟的行业也将错过未来的Llama-3多模态版本,未来的AI技术只能隔岸观火,干着急了。

Meta表示,这一决定是因为欧盟严格的隐私法规将使他们的AI技术在欧洲成为“二等公民”。这就好比你买了一辆法拉利,却只能在后院转圈,真是暴殄天物啊!

微软的全球IT故障:DIY修复指南

微软最近出了一档子大事,全球用户的Windows系统都出现了问题。微软给出了解决方案,简直就像在说:“兄弟们,自己修吧!”

微软的修复指南

1. 恢复系统:把你的电脑恢复到最近一次没有问题的状态。这就像你开车开错了路,然后决定掉头回去,找找刚才没走错的路口。

2. 修复OS磁盘:如果恢复没用,那就试试离线修复系统盘。这就好比你发现车胎漏气了,只能找个地方补胎。

3. 删除文件:微软还建议你删除一个特定的CrowdStrike系统文件,他们觉得这文件才是“罪魁祸首”。这有点像是你家电器坏了,结果发现是某个螺丝出了问题,拆掉它就好了。

结论

微软的意思其实很简单:问题不大,动动手就能解决。你得像个修理工一样,自己动手丰衣足食。不过要是你觉得修电脑比修车还难,可能还是找个专业的帮你修一下比较靠谱。

这次微软云服务的故障导致了澳大利亚多个银行和航空公司的大规模IT中断,这可真是一场“大新闻”。

微软云就像是数字世界的“天气预报员”,而这次却是它自己“下雨了”。问题的起源竟然是由一家名为CrowdStrike的软件引发的,这家公司本来是提供安全监控服务的,但这次却变成了“搞事情”的主角。

咱们来看看这次事故的几个搞笑亮点:

1. “超级安全软件”的反面教材:

- CrowdStrike本来是帮大企业盯梢电脑里的可疑活动,结果自己出了岔子。这就像是请了个保镖,结果保镖自己不小心给你一拳。

2. “技术”也是个双刃剑:

- Dr. Shaanan Cohney说得好,这种安全软件因为权限太高,一旦出错就能“殃及池鱼”,整个系统说挂就挂。编程的小错误也能变成大灾难,真是“高处不胜寒”啊。

3. “数字蝴蝶效应”:

- 微软云出了问题,影响的不仅仅是单一企业,而是波及到了整个行业,银行、航空公司全部躺枪。这就好比在数字世界里打了个喷嚏,整个生态都感冒了。

对于这些银行和航空公司来说,这次事件无疑是一次“痛苦的学习机会”:

- 加大系统冗余和容错设计:要确保单点故障不会带来整个系统的崩溃,必要的时候可以考虑多云策略,不把所有鸡蛋放在一个篮子里。

- 提升内部安全和应急响应能力:虽然CrowdStrike出错了,但企业自身的应急预案也需要更加完善,以应对类似的突发事件。

未来的破局之路:

- 加强云服务供应商的选择和评估:企业需要仔细甄选云服务供应商,确保他们有足够的技术能力和可靠的服务保障。

- 分布式架构和多云策略:采用分布式架构,避免单一云服务的依赖。同时,考虑多云策略,分散风险。

- 定期安全演练和漏洞测试:定期进行安全演练,模拟各种可能的故障场景,及时发现和修复漏洞,提升整体系统的鲁棒性。

总之,这次微软云的“大滑铁卢”事件给所有依赖云服务的企业敲响了警钟。希望各大企业能从中吸取教训,未雨绸缪,提升自身的技术和安全防护能力,避免类似事件的重演。

当智能便宜得像白菜一样时,它就会遍地都是。

GPT-4o mini呢,虽然个头小,智商可能比不上那些大模型,但用来处理一堆简单的小任务,那可是绰绰有余。

就像你买了个迷你电饭煲,虽然不能煮满汉全席,但每天煮个白米饭那是相当给力。GPT-4o mini也是这个道理,虽然不能解答所有高深问题,但让它帮你查个天气、安排个日程,或者解决一些基础的小问题,那简直是小菜一碟。

所以啊,别看它个头小,放对地方用,它可是能省你不少事儿!

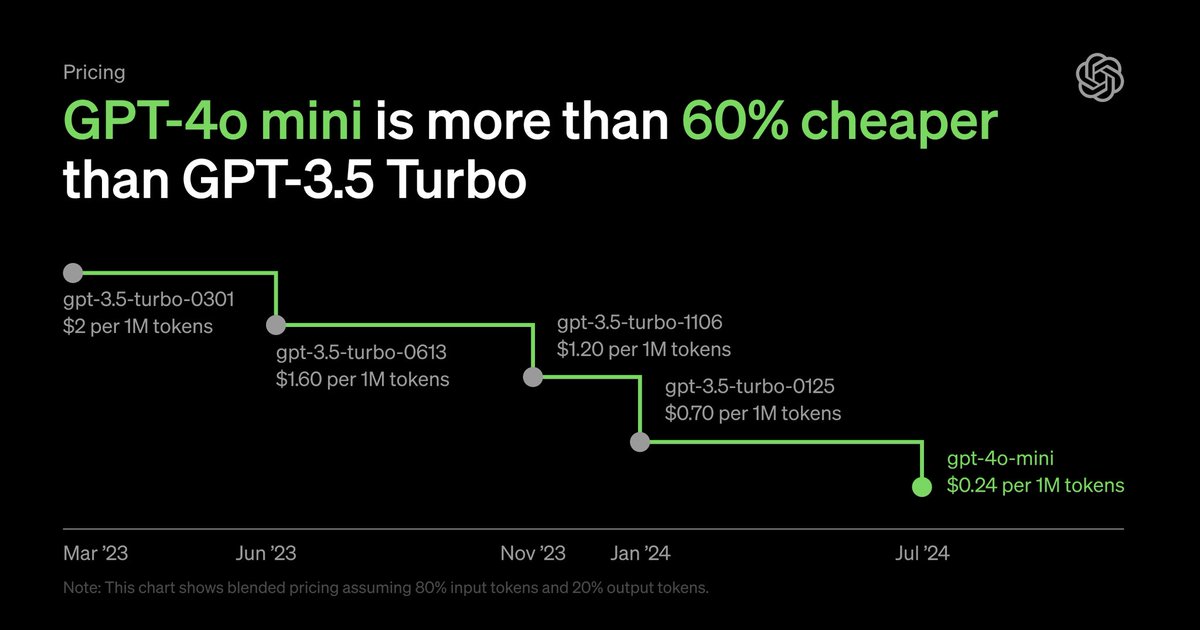

价格,2年,降低100倍!

输入每1M token 15美分,输出每1M token 60美分。

1M token = 2500页书。

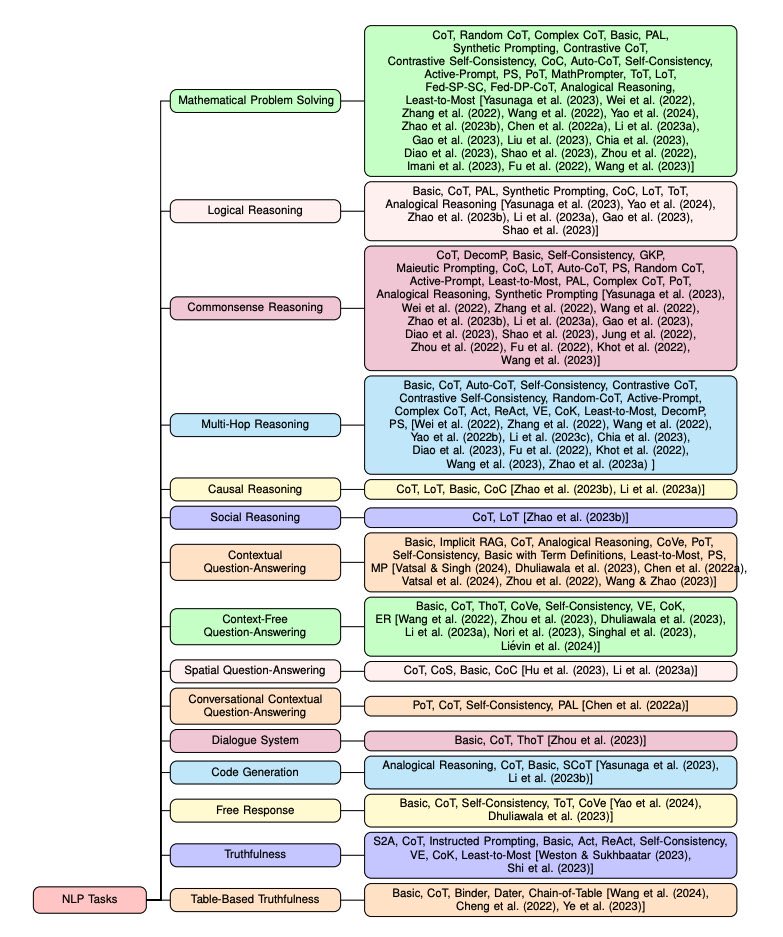

让我们详细解读一下这张Prompt图:

图的总体内容:

这张图展示了各种自然语言处理(NLP)任务,以及在这些任务中各种技术和方法的应用。每个任务都有不同的颜色标注,看起来像是一个多彩的任务树。

具体解读:

1. Mathematical Problem Solving(数学问题解决):

你要搞定数学题?这里有一堆方法帮你,比如CoT(Chain of Thought,链式思维)、Random CoT(随机链式思维)和Complex CoT(复杂链式思维)等等。这些方法让AI像人一样一步一步解题,而不是直接给你一个答案。

2. Logical Reasoning(逻辑推理):

想让AI变得更聪明会思考?这里有Basic(基础逻辑)、CoT(链式思维)、PAL(计划式逻辑)等方法。就像你在解逻辑题时,一步一步地推理,AI也需要这些技巧。

3. Commonsense Reasoning(常识推理):

让AI懂点常识,比如“太阳是热的”。这里有CoT、Decomp(分解推理)、Self-Consistency(自我一致性)等方法,帮AI变得更“接地气”。

4. Multi-Hop Reasoning(多跳推理):

这就像是解答那些需要多步才能搞定的问题。你需要一步步跳跃推理,AI也一样。比如从“李雷喜欢打篮球”推理出“李雷可能买了篮球鞋”,需要多个跳跃的思维过程。

5. Causal Reasoning(因果推理):

要让AI明白“因为……所以……”的逻辑。比如“下雨了,所以路滑了”。有了CoT和LoT(Logic of Thought,思维逻辑),AI就能搞明白这些因果关系。

6. Social Reasoning(社交推理):

让AI明白人际关系。比如谁是朋友,谁是同事。CoT和LoT也在这里起作用。

7. Contextual Question-Answering(上下文问答):

AI要在上下文里回答问题,比如在一段对话中找到答案。用Implicit RAG(隐式检索生成)和Self-Consistency(自我一致性)等方法,确保AI答得准确。

8. Context-Free Question-Answering(上下文无关问答):

这是问一些独立的问题,不需要上下文背景。ER(Example Retrieval,例子检索)等方法帮助AI搞定这些独立的问题。

9. Spatial Question-Answering(空间问答):

让AI明白空间关系,比如“桌子上有什么?”用CoT和CoS(Chain of Space,空间链式思维)等方法。

10. Conversational Contextual Question-Answering(对话上下文问答):

在对话中回答问题,需要搞清楚前后文。用PoT(Prompt of Thought,思维提示)和Self-Consistency(自我一致性)等方法。

11. Dialogue System(对话系统):

让AI和你聊天,还得聊得有道理,用Basic、CoT、Self-Consistency等方法。

12. Code Generation(代码生成):

AI写代码,得明白逻辑和结构,用Analogical Reasoning(类比推理)和CoT等方法。

13. Free Response(自由回答):

AI自由发挥回答问题,用Basic、CoT等方法。

14. Truthfulness(真实):

确保AI说真话,用S2A(Statement to Answer,陈述到回答)和CoT等方法。

15. Table-Based Truthfulness(基于表格的真实):

确保AI基于数据表回答时保持真实,用Basic、CoT等方法。

总结:

这张图展示了让AI更聪明、更接地气、更会聊天、更能写代码的各种方法。每种颜色代表不同类型的任务,具体方法列在每个任务下,让你一目了然AI都用什么技巧来完成这些任务。搞懂这些,你就能知道AI是怎么一步步变得更聪明的!

Garry Tan的意思就是,如果你能找到对的人,聊够多次天,他们会帮你找到最好的生活方式。想象一下,你跟100个人唠嗑,聊个一万次,几乎所有的糟心路都会被排除掉,你只剩下好路走了!

生活中的例子:

假设你是个刚毕业的大学生,没啥方向感。如果你每天跟不同的职场前辈、成功人士、创业者交流,他们会告诉你很多宝贵的经验和建议。这些对话会帮你避开职场上的坑,比如选错行业、误入不靠谱的公司,最终让你找到一条最适合你的成功之路。就是这么个理儿!

💥大新闻

OpenAI推出了GPT-4o mini,它要替代GPT 3.5了

性能甩GPT-4几条街

而且更快更便宜

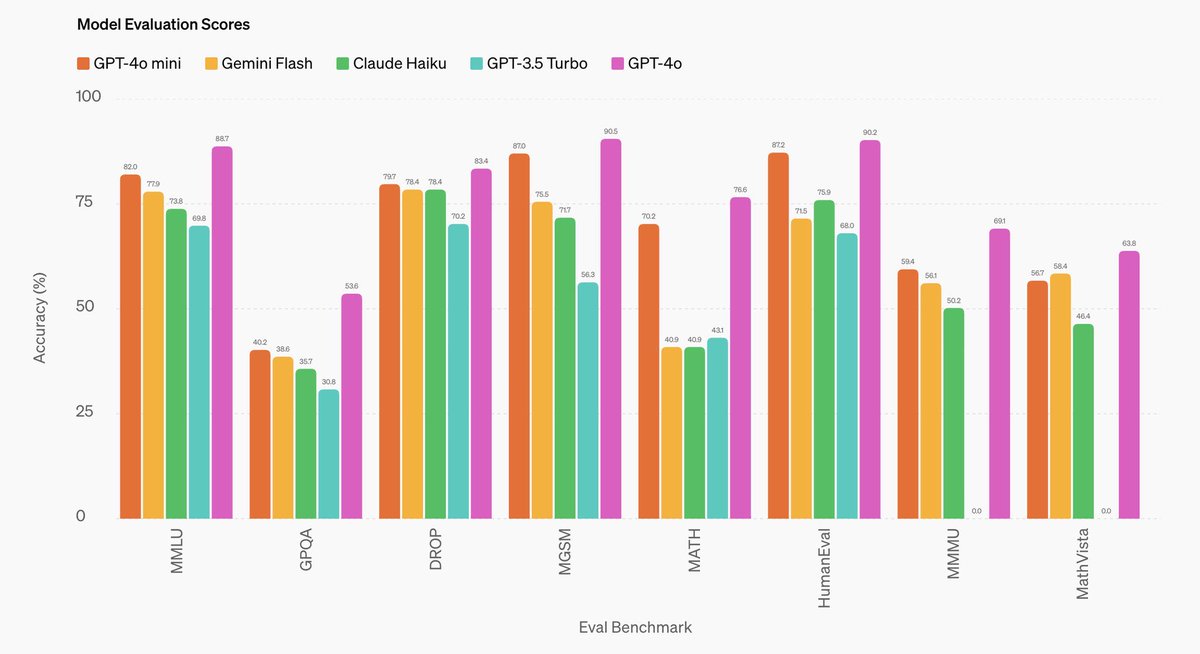

在MMLU上得了82%,在LMSYS排行榜上比GPT-4还受欢迎

定价:每百万输入token只要15美分,输出token只要60美分,比之前的模型便宜了一个数量级,比GPT-3.5 Turbo便宜了60%以上

GPT-4o mini不仅支持文本和视觉输入,未来还支持图像、视频和音频输入输出。它有128K的上下文窗口,每次请求支持最多16K的输出标记

1. 文本智能和推理任务:

- MMLU得分82.0%,比Gemini Flash的77.9%和Claude Haiku的73.8%更高

2. 数学和编码任务:

- MGSM得分87.0%,比Gemini Flash的75.5%和Claude Haiku的71.7%高

- HumanEval得分87.2%,超过Gemini Flash的71.5%和Claude Haiku的75.9%

3. 多模态推理任务:

- MMMU得分59.4%,比Gemini Flash的56.1%和Claude Haiku的50.2%更高

总之,GPT-4o mini就是这么强大,这么便宜,这么快!谁能不喜欢呢?

这段话在讲特斯拉自动驾驶网络中的“离线追踪器”,以及它在大型语言模型(LLM)中的应用。简要解释如下:

1. 离线追踪器的作用:它是一种生成合成数据的过程。先用以前的、更弱的模型(比如单帧模型或只识别边界框的模型)处理视频片段,然后在离线环境中进行3D和时间重建,生成更干净的训练数据。

2. 3D多摄像头视频网络的优化:通过这种方式,可以为3D多摄像头视频网络生成大规模、更优质的训练数据。

3. 与LLM的相似性:同样的过程也适用于大型语言模型(LLM)。LLM也需要利用之前的模型生成更优质的训练数据来提高性能。

总结一下,特斯拉的“离线追踪器”通过重建和优化视频数据来提升自动驾驶的能力,同样的方法也可以用来优化语言模型的数据训练过程。

这条推特主要在说当前的大型语言模型(LLMs)的发展趋势,并预测未来模型的优化方向。简单来说:

1. 模型会变小但更聪明:作者认为未来的模型会越来越小,但思考能力会更强。目前模型很大,是因为在训练时让它们记住了很多不必要的东西,比如互联网中的大量信息。

2. 模型的记忆力很强:这些模型在记忆方面比人类强很多,只需一次训练就能记住很多细节。

3. 训练目标的问题:目前训练模型的方法要求它们能够背诵互联网上的任意段落,就像在闭卷考试中需要记住大量细节。这是因为训练数据中思考和知识是交织在一起的。

4. 未来的优化方法:为了让模型变得更小更聪明,先要让它们变大,利用这些大模型帮助整理和优化训练数据,最终得到“完美的训练集”。这样,即使用一个小模型训练,也能变得非常强大。

5. 可能的影响:虽然未来的小模型在某些具体知识上(比如化学)可能不如现在的大模型,但整体上会更加聪明和高效,偶尔需要查阅一些信息。

总结起来,这条推特在讨论语言模型的发展趋势,预示未来的小模型将会变得更聪明,但目前的目标是利用大模型优化训练数据,逐步提升模型的质量。

GPT-4o mini:推进高性价比的智能技术(全文译)

OpenAI致力于让智能技术广泛普及。今天,我们宣布推出GPT-4o mini,这是我们最具成本效益的小模型。我们预计,GPT-4o mini将大大扩展基于AI构建的应用程序范围,因为它使得智能技术变得更加实惠。GPT-4o mini在MMLU上得分82%,目前在LMSYS排行榜上的聊天偏好得分超过了GPT-41。其价格为每百万输入token 15美分和每百万输出token 60美分,价格比之前的前沿模型便宜一个数量级,比GPT-3.5 Turbo便宜超过60%。

广泛的应用能力

由于低成本和低延迟,GPT-4o mini能够处理多种任务,如多次模型调用(例如调用多个API)、传递大量上下文信息(例如完整代码库或对话记录)、或通过快速实时文本回复与客户互动(例如客户支持聊天机器人)。

目前,GPT-4o mini在API中支持文本和视觉,将来还会支持文本、图像、视频和音频输入输出。模型有128K tokens的上下文窗口,每次请求支持最多16K输出tokens,并且拥有截至2023年10月的知识。由于与GPT-4o共享改进的tokenizer,处理非英语文本现在更加经济高效。

优越的文本智能和多模态推理能力

GPT-4o mini在学术基准测试中,在文本智能和多模态推理方面超越了GPT-3.5 Turbo和其他小模型,并且支持与GPT-4o相同的语言范围。它在函数调用方面表现强劲,使开发者能够构建应用程序以从外部系统提取数据或执行操作,而且与GPT-3.5 Turbo相比,它在长上下文性能上有显著提升。

关键评估数据

GPT-4o mini在多个关键基准上进行了评估:

- 推理任务:GPT-4o mini在涉及文本和视觉的推理任务中表现优于其他小模型,在MMLU上的得分为82.0%,相比之下Gemini Flash得分77.9%,Claude Haiku得分73.8%。

- 数学和编码能力:GPT-4o mini在数学推理和编码任务中表现出色,超过了市场上的其他小模型。在MGSM(数学推理评估)中,GPT-4o mini得分87.0%,而Gemini Flash得分75.5%,Claude Haiku得分71.7%。在人类评估编码表现的HumanEval中,GPT-4o mini得分87.2%,相比之下Gemini Flash得分71.5%,Claude Haiku得分75.9%。

- 多模态推理:GPT-4o mini在MMMU(多模态推理评估)中的表现也很强,得分为59.4%,相比之下Gemini Flash得分56.1%,Claude Haiku得分50.2%。

GPT-4o mini的推出,使得高性价比的AI变得更加普及,推动了AI应用的广泛发展。

https://t.co/NRHbzgjkcu了解到,作为模型开发过程的一部分,OpenAI与一些值得信赖的合作伙伴合作,以更好地理解GPT-4o mini的使用案例和局限性。他们与Ramp和Superhuman等公司合作,发现GPT-4o mini在从收据文件中提取结构化数据或在提供线程历史的情况下生成高质量电子邮件回复方面,比GPT-3.5 Turbo表现更好。

内置安全措施

安全性从模型开发开始就被纳入,并在每一步中得到加强。在预训练阶段,过滤掉了不希望模型学习或输出的信息,如仇恨言论、成人内容、主要聚合个人信息的网站和垃圾邮件。在后期训练中,使用人类反馈强化学习(RLHF)等技术来提高模型响应的准确性和可靠性。

GPT-4o mini与GPT-4o拥有相同的安全措施,经过自动和人工评估,根据Preparedness Framework和自愿承诺进行了仔细评估。超过70名外部专家在社会心理学和错误信息等领域对GPT-4o进行了测试,以识别潜在风险,并计划在即将发布的GPT-4o系统卡和Preparedness评分卡中分享详细信息。这些专家评估的见解有助于提高GPT-4o和GPT-4o mini的安全性。

在此基础上,团队还通过新的研究技术提高了GPT-4o mini的安全性。GPT-4o mini是API中第一个应用指令层次结构方法的模型,这有助于提高模型抵御越狱、提示注入和系统提示提取的能力。这使得模型的响应更加可靠,也使得在大规模应用中使用更安全。

我们将继续监控GPT-4o mini的使用情况,并随着新风险的发现改进模型的安全性。

可用性和定价

GPT-4o mini现在可以作为文本和视觉模型在Assistants API、Chat Completions API和Batch API中使用。开发者支付每百万输入token 15美分和每百万输出token 60美分(相当于标准书籍中的2500页)。我们计划在未来几天推出GPT-4o mini的微调功能。

在ChatGPT中,免费、Plus和Team用户今天起可以使用GPT-4o mini,替代GPT-3.5。企业用户下周也可以访问,这符合我们让所有人都能受益于AI的使命。

未来展望

过去几年中,我们见证了AI智能的显著进步以及成本的大幅下降。例如,自2022年引入的较弱模型text-davinci-003以来,GPT-4o mini的每个token成本下降了99%。我们致力于继续降低成本,同时提高模型能力。

我们展望一个未来,模型将在每个应用程序和网站中无缝集成。GPT-4o mini正为开发者更高效、更经济地构建和扩展强大的AI应用程序铺平道路。AI的未来正变得更加普及、可靠,并嵌入到我们的日常数字体验中,我们很高兴继续引领这一潮流。

https://t.co/NRHbzgiMmW了解到,OpenAI最近推出了GPT-4o mini。早期版本“upcoming-gpt-mini”在上周进行了测试,并获得了超过6000个用户的投票反馈。令人兴奋的是,它的表现达到了GPT-4-Turbo的水平,同时价格显著降低,输入token每百万15美分,输出token每百万60美分。

目前,官方版本“gpt-4o-mini”已经上线,正在重新收集投票,以更新排行榜的结果。这个新模型不仅性价比高,还得到了用户的广泛认可,预计会有很好的使用体验。

根据https://t.co/NRHbzgiMmW的分析,OpenAI推出的最新模型GPT-4o mini以其低廉的价格和高效的性能引起了广泛关注。以下是详细解读:

关键信息

1. 成本效益: GPT-4o mini的定价为每百万输入token 15美分和每百万输出token 60美分,这比GPT-3.5 Turbo便宜了超过60%。这意味着用户能够以更低的成本获得更强大的AI服务,极大地降低了使用门槛。

2. 性能: GPT-4o mini的MMLU(Massive Multitask Language Understanding)得分为82%,显示出其在处理多任务语言理解方面的卓越能力。这个高分表明模型在广泛的语言任务中具有出色的表现。

3. 速度: 新模型不仅价格低廉,还拥有更快的处理速度。快速的响应时间使其在需要即时反馈和高效处理的应用场景中表现优异。

详细解读

- 成本效益分析: 对于开发者和企业来说,降低AI使用成本是非常重要的。GPT-4o mini的价格结构使得AI服务变得更为普及,无论是大规模企业还是中小型开发者,都能负担得起。随着更多人能够使用先进的AI技术,预计将会有更多创新应用涌现,推动整个行业的发展。

- 性能表现: MMLU得分82%代表了GPT-4o mini在复杂语言任务中的高效性和准确性。这一成绩使得该模型在需要高精度和高可靠性的应用中具有显著优势,例如自然语言处理、内容生成和语言翻译等领域。

- 使用体验: 根据OpenAI的说法,用户对新模型的使用体验非常满意。这不仅仅是因为它的成本和性能优势,还因为它在实际应用中的表现更加直观和友好。更快的响应速度和更高的准确性提升了用户的整体体验。

总结

GPT-4o mini的推出标志着AI技术的又一次飞跃。https://t.co/NRHbzgiMmW分析认为,这款模型以其无与伦比的性价比和卓越的性能,将在未来的市场中占据重要地位。用户可以期待以更低的成本享受到更高质量的AI服务,从而推动更多创新和进步。

更多详细信息可以访问 OpenAI官网。

Karpathy刚刚宣布他要创办一所“AI原生学校”,开始教人们如何构建大型语言模型(LLMs)。这听起来非常酷!想象一下,如果将这项技术应用到中学生和高中生的学习中,将会带来多大的改变。

LLMs(大型语言模型)可以根据学生的需求定制个性化课程,评估学习游戏和测验的效果,甚至随时进行小测验。这种AI教学助手可以理解你的学习需求,与学生进行深入的交流,针对你的能力提出建议,甚至如果你不适合传统的学校教育,它会建议你退学,探索其他更适合的学习途径。

对未来人类的意义

1. 个性化学习:

AI可以根据每个学生的兴趣、能力和学习进度,定制个性化的学习计划。这意味着每个学生都能按照最适合自己的节奏学习,避免了一刀切的教育方式。

2. 高效评估:

AI能够实时评估学生的学习效果,快速找出他们的弱点和强项。这不仅帮助学生更快地提高成绩,也减轻了教师的工作负担。

3. 互动式教学:

AI教学助手可以与学生进行互动,解答他们的问题,提供即时反馈。这种互动性让学习过程更加生动有趣,激发学生的学习兴趣。

4. 跨学科教育:

AI可以整合不同学科的知识,提供综合性的教育体验。学生可以在学习数学的同时,理解其在科学或工程中的应用,促进跨学科的理解和思考。

5. 终身学习:

AI辅助教育不仅限于学校教育,还可以延伸到职业培训和终身学习。无论你在哪个年龄段,都可以通过AI获得最新的知识和技能,保持竞争力。

6. 教育公平:

AI教育资源可以广泛传播,尤其是对于那些无法获得优质教育资源的偏远地区和贫困学生。通过AI,他们也能享受到高质量的教育,缩小教育差距。

总之,AI在教育领域的应用将彻底改变传统的教学模式,使学习变得更加个性化、高效和有趣。未来,AI将成为每个学生学习旅程中的重要伙伴,帮助他们更好地掌握知识,探索兴趣,全面发展。

这项研究对于提高人工智能系统的可验证性和可信度具有重要意义,以下是一些关键点:

提高透明度

通过训练高级语言模型生成的文本能够被较弱的模型轻松验证,可以显著提高AI系统的透明度。这样一来,AI生成的内容不仅对人类更易于理解和评估,也能被其他AI系统检查和验证。这种透明度是建立信任的基础,有助于消除用户对AI系统的怀疑和不信任。

增强可解释性

AI系统的可解释性一直是一个重要的研究方向。通过这种方法,生成的文本变得更加清晰和易于解释。这不仅对技术专家有帮助,对普通用户也是如此。用户可以更容易地理解AI系统的输出和决策过程,从而更愿意依赖这些系统。

减少误导性信息

高级语言模型如果生成的文本难以验证,可能会带来误导性的信息。通过这种新方法,较弱的模型可以帮助验证高级模型的输出,减少了错误和误导性信息的传播。这对AI应用于关键领域(如医疗、金融等)尤为重要,确保了信息的准确性和可靠性。

提升系统安全性

在AI系统的安全性方面,这项研究也起到了积极作用。通过增加验证步骤,可以减少高级模型产生有害或不适当内容的风险。这种多层次的验证机制能够更好地保护用户,防止潜在的滥用和错误。

促进AI发展

这种方法不仅对现有系统有益,对未来的AI发展也具有重要意义。通过不断改进模型的验证和生成能力,可以推动整个AI领域向更加可靠和可信的方向发展。这种研究方法为构建更复杂、更强大的AI系统提供了坚实的基础。

综上所述,这项研究在提高AI系统的可验证性和可信度方面具有重大意义,能够为用户提供更加可靠、安全和透明的AI服务,有助于推动AI技术的广泛应用和发展。

李飞飞教授的最新创举震撼AI领域!

据彭博社报道,这位斯坦福大学的AI先锋在短短4个月内创立了一家估值10亿美元的初创公司——World Labs。该公司获得了a16z和Radical Ventures等顶级投资者的青睐,最近一轮融资筹集了约1亿美元。

World Labs专注于类人视觉数据处理技术,旨在实现AI的“空间智能”,让机器能够像人类一样理解和导航三维世界。在温哥华的TED演讲中,李飞飞教授展示了这一研究的巨大潜力,并在Databricks峰会上宣告了数字寒武纪的到来。

空间智能将大幅提升人与机器的互动,推动复杂自主系统的发展。投资人表示,World Labs开发的模型将理解物体的尺寸、位置及功能,标志着AI领域的重大突破。

桥水基金CIO认为,当前AI公司的盈利能力远超1999年的思科,AI周期投资机会已经显现。

这个厉害👍

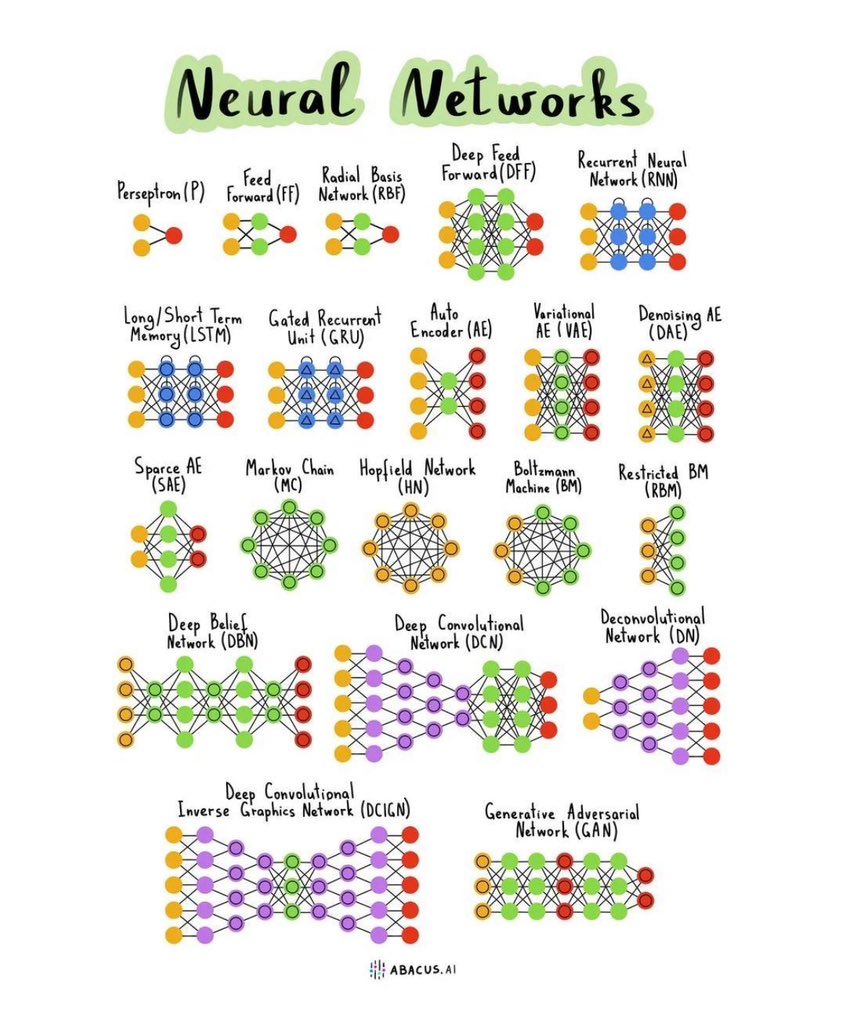

🤖【AI小白必读:神经网络图解】🤖

这张图展示了各种神经网络的结构,简直就是AI界的家族谱!让我们一起来看看这些神经网络的成员们:

1. Perceptron (P):最基础的神经元模型,就像AI的最初细胞。

2. Feed Forward (FF):简单的前馈网络,数据只往前走,不回头。

3. Radial Basis Network (RBF):用径向基函数处理数据,适合分类任务。

4. Deep Feed Forward (DFF):比FF多层,能处理更复杂的数据。

5. Recurrent Neural Network (RNN):适合处理序列数据,记忆力强,可以用来做语音识别。

6. Long/Short Term Memory (LSTM):RNN的升级版,记忆力更持久,不容易忘事儿。

7. Gated Recurrent Unit (GRU):LSTM的简化版,效率更高。

8. Auto Encoder (AE):数据压缩大师,把数据压缩再还原,适合去噪音。

9. Variational AE (VAE):AE的高级版,能生成数据,比如生成新的图片。

10. Denoising AE (DAE):专注去噪音,让数据更干净。

11. Sparse AE (SAE):稀疏编码器,强调数据的关键特征。

12. Markov Chain (MC):基于概率的序列模型,常用于文本生成。

13. Hopfield Network (HN):记忆网络,能记住多种模式并自动匹配。

14. Boltzmann Machine (BM):能量模型,适合优化和生成数据。

15. Restricted BM (RBM):BM的简化版,更高效。

16. Deep Belief Network (DBN):层层堆叠的BM,强大的生成能力。

17. Deep Convolutional Network (DCN):图像处理神器,擅长识别图像特征。

18. Deconvolutional Network (DN):逆卷积网络,用于图像重建。

19. Deep Convolutional Inverse Graphics Network (DCIGN):逆向图形网络,把图像分解为基本元素。

20. Generative Adversarial Network (GAN):生成对抗网络,两个神经网络相互竞争,生成超逼真的数据。

---

通过这张图,能一眼看出各种神经网络的构造和用途,简直是AI世界的藏宝图!了解更多神经网络知识,赶紧收藏这张图吧!

泰国目的地签证(DTV)对数字游民来说是一项极具吸引力的政策,具体意义如下:

1. 长期居留便利:DTV签证一次办理有效期长达5年,每次最长可停留180天,这意味着数字游民可以在泰国长期居住,而无需频繁办理签证。

2. 灵活的续签方式:通过手动续签或visa run的方式,可以轻松延续停留时间,极大地增加了灵活性和便利性。

3. 简化的申请条件:只需提供50万泰铢(约10万元人民币)的存款证明,以及一份远程工作合同或作品集即可申请,门槛相对较低,使更多的数字游民有机会获得签证。

4. 低成本:办理费用仅2000多人民币,对于数字游民来说,性价比非常高,能显著降低在泰国生活和工作的成本。

5. 丰富的生活体验:泰国以其优美的自然风光、丰富的文化、美食和友好的环境,成为数字游民的理想目的地。DTV签证为他们提供了一个在泰国稳定生活和工作的机会。

据https://t.co/NRHbzgjkcu分析,DTV签证将进一步巩固泰国作为全球数字游民热点的地位,吸引更多的加密货币交易者和开发者到此居住和工作。想要了解更多信息,可以访问泰国e签证官网:https://t.co/fY3JsdOSY2。

加州通过法案AB1955,禁止学校在未经学生允许的情况下向家长透露其性别认同或性取向。这一法案的支持者认为,该措施有助于保护生活在不友好家庭环境中的LGBTQ+学生。然而,这一法律却引发了巨大的争议,甚至促使Elon Musk公开表示愤怒,并决定将SpaceX总部迁出加州。

Elon Musk的推特谴责如下:

---

这简直是压垮骆驼的最后一根稻草。加州州长纽森刚刚签署了AB1955法案,这项法案禁止学校在学生选择使用不同的姓名和代词或表达跨性别身份时通知家长。这意味着,家长将被排除在了解自己孩子重要决定的过程之外。

我一年前就警告纽森州长,这个法律的性质将会迫使很多家庭和公司搬离加州来保护他们的孩子。现在,我要兑现我的警告。SpaceX将立即启动总部搬迁计划,迁往德州。在那里,我们将继续我们的使命,而不受这些极端法律的干扰。

纽森州长,你的政策已经失控,加州的家庭和企业正在为此付出代价。保护孩子意味着让父母参与他们的生活,而不是将他们排除在外。希望你能意识到这一点,但很遗憾,现在已经太晚了。

---

Elon Musk

---

通过这样的推特,Musk不仅表达了对新法案的不满,还明确了他的行动计划,显示出对加州政策的不认同。这一决定无疑会对加州的经济和社会环境产生深远影响。