理解AI模型开发中的关键选择:提示工程、RAGs和微调

在开发基于大语言模型(LLM)的应用程序时,AI工程师需要在几种方法中做出选择:提示工程、RAGs(检索增强生成)和微调。为了更好地理解这些选择,我们先来看看它们的具体含义。

1️⃣ 提示工程(Prompt Engineering)

提示工程就是设计输入文本,指导模型生成所需的输出。简单来说,就是通过精心设计的输入来引导模型基于其已有知识库生成合适的回应。

2️⃣ RAGs(检索增强生成)

RAGs结合了提示工程与数据库查询,以提供背景丰富的答案。通过这种方法,生成的输出不仅依赖于LLM的知识,还结合了数据库中可用的信息。

3️⃣ 微调(Finetuning)

微调是指使用特定任务的数据调整LLM的参数,使其专注于某一领域。例如,将语言模型微调至医疗文本,使其更擅长回答健康相关的问题。这就像给一个已经有技能的工人进行额外培训,使其成为特定领域的专家。

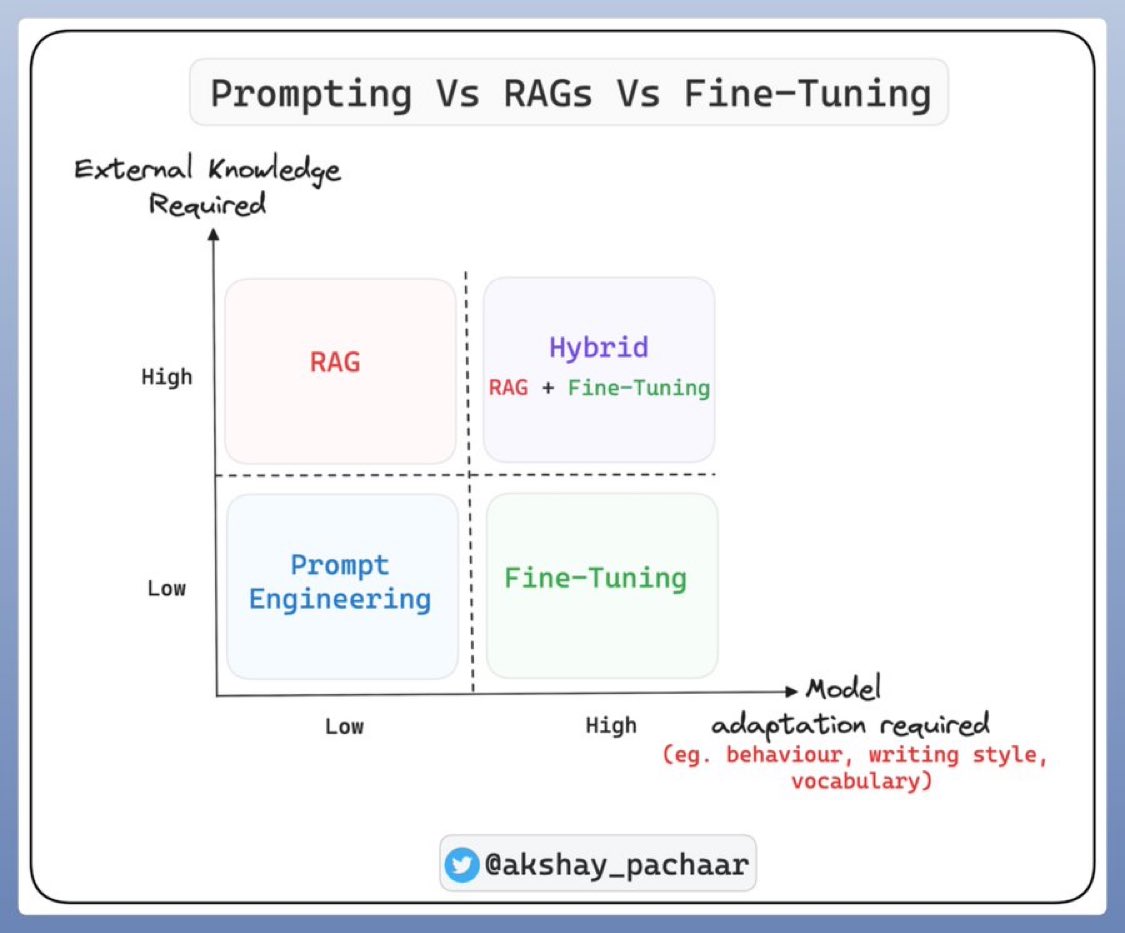

如何决定采用哪种方法?

这个决定主要取决于两个重要因素:对外部知识的需求和对模型适应性的需求。

- 外部知识需求:如果需要从自定义知识库中获取信息,则可能需要使用RAGs。

- 模型适应性需求:如果需要改变模型的行为,比如词汇或写作风格,则微调是更好的选择。

例如,一个预训练的LLM可能难以总结公司会议记录,因为这些记录中可能包含内部术语。在这种情况下,微调可以帮助改变模型结构以适应这些术语,而RAGs则可以在不改变写作风格的情况下提供基于自定义数据库的信息。

因此,如果你只需要定制化知识而不需改变模型行为,可以选择RAGs;如果你既需要定制化知识又要改变模型行为,最好使用混合方法(RAGs + 微调)。如果两者都不需要,仅依赖提示工程即可。

场景应用

假设你正在开发一个用于法律咨询的AI助手。法律领域有大量专业术语,并且每个国家或地区都有不同的法律法规。在这种情况下,你可以:

- 使用RAGs:连接到一个包含最新法律法规的数据库,以便在回答问题时引用最新法规。

- 使用微调:将LLM调整为能够理解和使用法律术语及复杂逻辑推理。

- 或者结合两者,实现一个同时具备专业知识并能使用专业语言风格的强大AI助手。