解密大语言模型:贪婪策略、多项式采样、束搜索与对比搜索

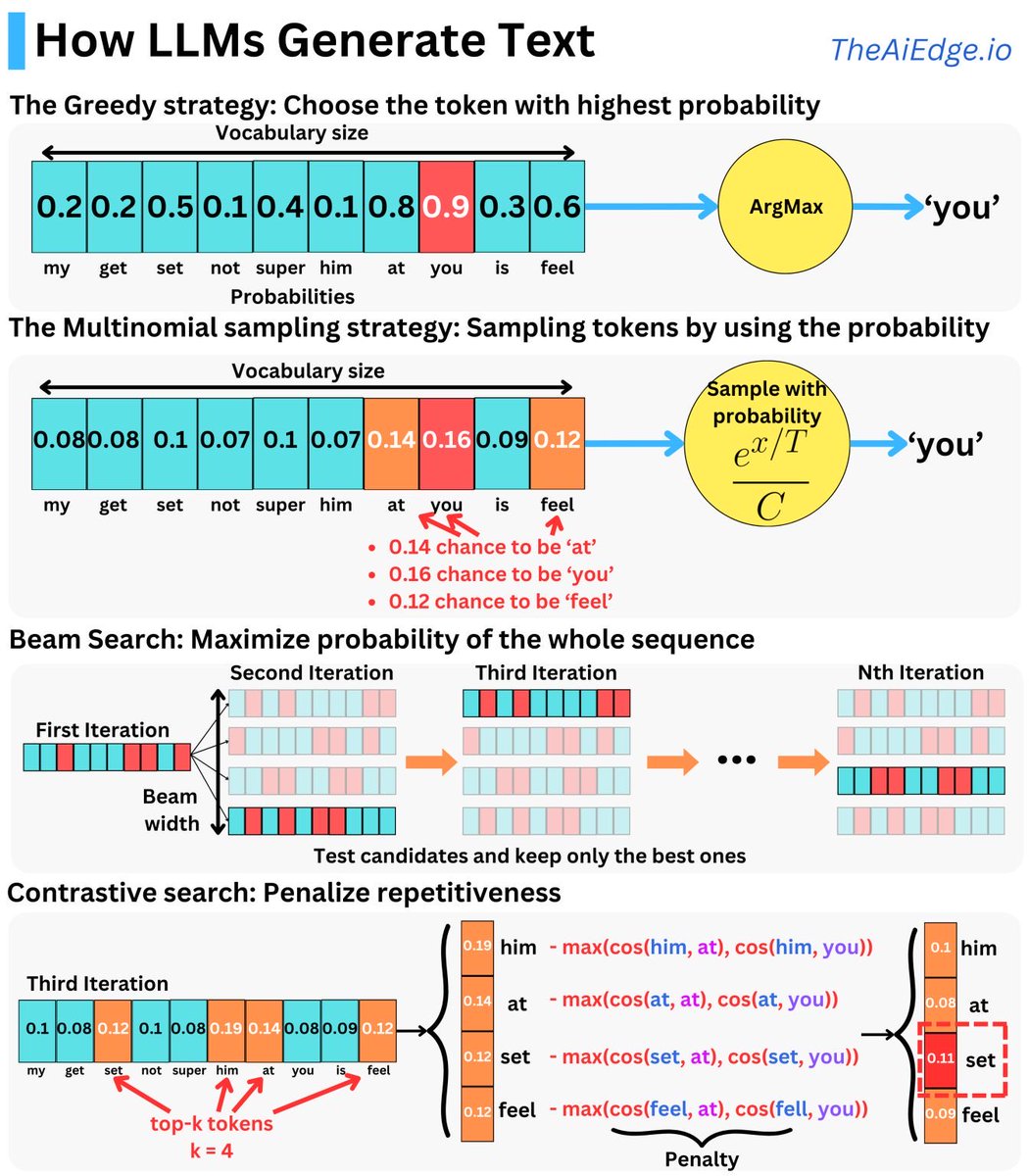

这张图详细展示了大语言模型(LLMs)生成文本的几种主要策略,包括贪婪策略、多项式采样策略、束搜索和对比搜索。以下是每种策略的解释及其实际应用场景:

1. 贪婪策略(Greedy Strategy)

功能

贪婪策略每次选择概率最高的单词。比如在图中,`you`的概率是0.9,是所有选项中最高的,所以选择`you`。

场景事例

你在使用智能回复功能的聊天应用时,系统会迅速给出最有可能的回复,比如“你好!需要帮助吗?”这个回复是通过贪婪策略直接选择最可能的单词生成的。

2. 多项式采样策略(Multinomial Sampling Strategy)

功能

多项式采样策略根据各个单词的概率进行抽样,而不是总是选择最高概率的单词。比如在图中,`you`有0.16的概率被选中,而其他单词如`at`和`feel`也有一定的概率被选中。

场景事例

当你在玩一个文字冒险游戏时,系统会根据不同选项的概率生成多个可能的发展路径,这使得游戏更加多样化和随机化。

3. 束搜索(Beam Search)

功能

束搜索通过保留多个候选序列来最大化整个序列的概率。在每次迭代中,都会保留最佳候选并继续扩展,直到找到最优解。

场景事例

当你使用翻译软件时,为了确保翻译句子的整体流畅度和准确性,系统会使用束搜索来评估多个翻译版本,并最终选择最优的一版。

4. 对比搜索(Contrastive Search)

功能

对比搜索通过惩罚重复性来减少文本中的冗余。它会计算相似度并进行适当惩罚,从而保证生成内容的新颖性和多样性。

场景事例

在自动写作工具中,为了避免生成重复内容,系统会使用对比搜索来确保输出内容丰富且不重复,比如在写一篇文章时,不会重复使用相同的短语或句子。

通过这些不同的策略,大语言模型能够根据具体需求灵活地生成各种类型的文本,使得应用更加智能和人性化。