开源巨兽觉醒:Mistral AI估值飙至20亿美元,创造史上最快成长神话!

Mistral AI最新一轮融资达到4.15亿美元,估值高达20亿美元,相比上一轮几乎增长了8倍。这一成就不仅是对Mistral AI团队在开源领域创新成果的认可,也标志着开源企业在技术和商业模式上的巨大进步。Mistral AI的快速成长反映了市场对开源技术及其潜力的高度评价和期待,同时也显示出开源模式在当今技术驱动的商业环境中的可行性和竞争力。

简单说,Mistral AI就是一个开源界的“独角兽”,价值飙升,速度快得惊人。他们不仅在开源世界里做出了牛事,还吸引了一大笔钱投资,让人看到了开源技术未来的大好前景。

在美国,SpaceX的Starlink卫星互联网套件现在可以在Costco购买了。

他们提供的套件售价为599美元。此外,Costco的会员购买后还可以获得两个月的免费服务。

这意味着消费者现在可以更方便地获取到Starlink的卫星互联网服务,同时Costco会员还能享受额外的服务优惠。这对希望获得更快、更可靠卫星互联网服务的消费者来说是一个好消息。

重要的科技进步:AI硬件加速器使蛋白质与DNA的对齐速度提高了10倍,从而大幅提升了基因组组装的效率。

这一进步可能对科学家更好地理解和治疗疾病具有重要意义。通过加速蛋白质和DNA的对齐过程,科学家能够更快地分析基因数据,这对于诸如癌症、遗传病等疾病的研究和治疗具有重大影响。

简而言之,这是一个在生物医学领域实现重大突破的激动人心的技术进展。

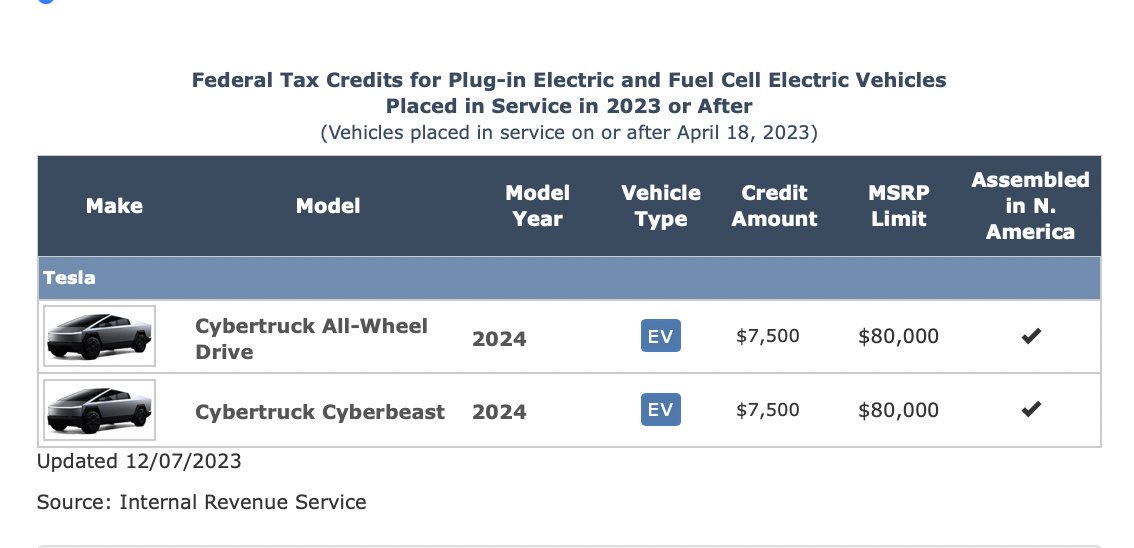

美国国税局(IRS)正式将特斯拉的Cybertruck AWD列为完全符合7,500美元电动车税收抵免的资格。

有趣的是,他们还提到价值10万美元的Cyberbeast也符合资格,这可能意味着如果未来Cyberbeast的价格降至8万美元以下,那么它也将符合税收抵免资格。这可能是国税局预见到未来某些高价电动车的价格下调,从而符合税收抵免的条件。

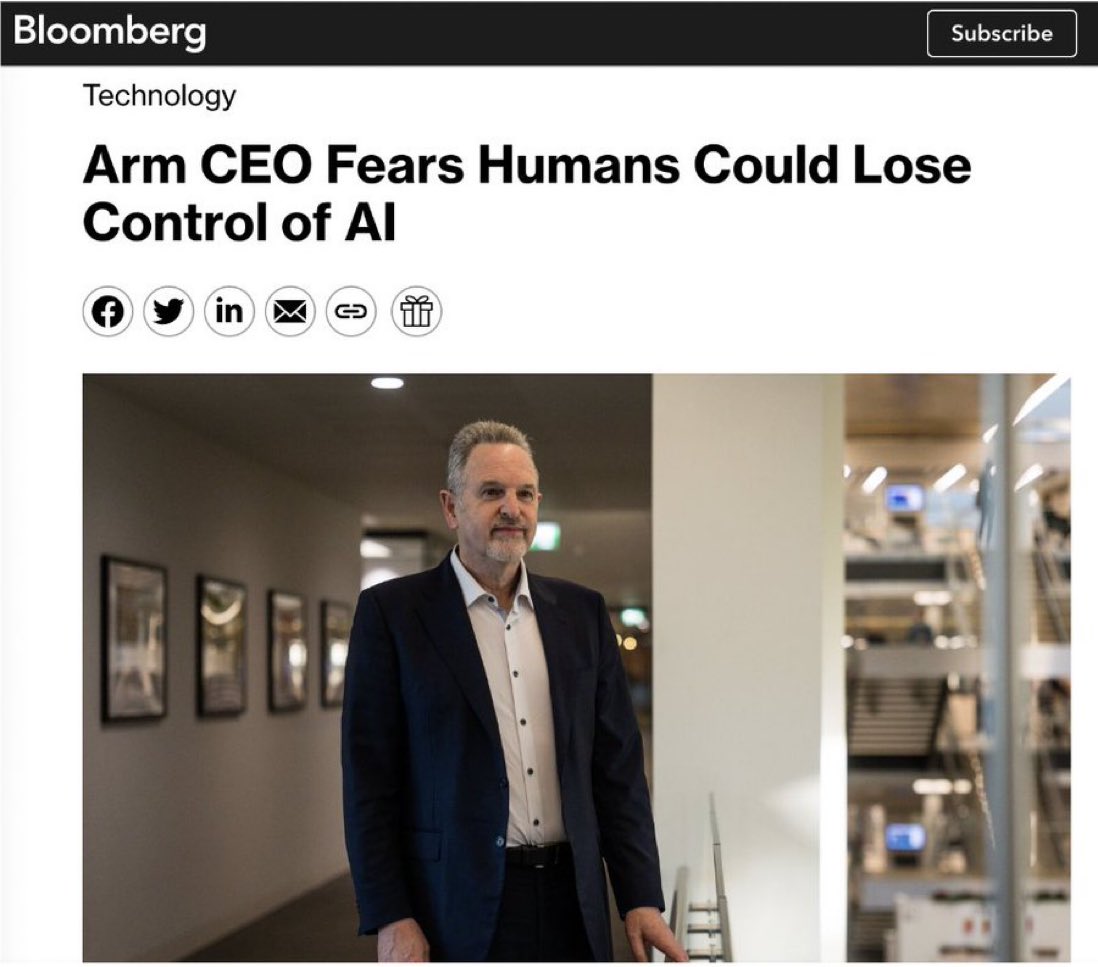

Arm首席执行官表示,他因为担心失去对人工智能的控制而失眠。他认为我们需要一个“紧急停止开关”。

为什么他的观点重要:Arm是全球最大的半导体公司之一。

当被问及让他夜不能寐的事情时,他提到了人工智能:

“我最担心的是人类对机器失去控制的能力。”

“你需要某种覆盖、某种后门、某种能够关闭系统的方法。”

“我认为[人工智能]会渗透到我们所做的一切中,影响我们的工作、生活、娱乐方式……它在未来五到十年将改变一切。”

AISafetyMemes的看法:大多数人可能会认为肯定有一个紧急停止开关,但事实上并没有。

我们需要立即构建一个。

开源意味着没有紧急停止开关。一旦模型被开源,这是不可逆的。

关于开源模型何时能够超越现有的主流模型,这个问题的答案并不确定,可能永远也不会发生。

我手动测试了20到30个不同的模型,这些模型都声称在针对OpenAI和Anthropic的基准测试中取得了令人印象深刻的成绩。我发现:

超小型模型正在变得非常优秀。

中等大小的模型开始在特定任务和提示调整上击败GPT-4。

如果你只想使用一个模型,GPT-4仍然有巨大的领先优势。

Claude-instant被低估了。

开源软件模型存在相当大的部署问题。

基本的设置规则很简单,就像是做蛋糕时的步骤顺序。想象一下,你在做一个特别的“语言模型蛋糕”,每一步都很重要。

1. 先放影响内容召回的原料(prompt):这就像是先把蛋糕的主要原料放进碗里。如果你的问题(prompt)会影响模型怎么“想”和“记住”信息,就要先提出来。就好比说,“我要做一个巧克力蛋糕”,这样模型就知道接下来的内容都要围绕巧克力展开。

2. 然后添加上下文:这就是蛋糕的其他原料和调味料。上下文提供了问题的背景和细节,帮助模型更好地理解整体情况。

3. 最后,放不影响内容召回的原料(prompt):这就像是在蛋糕糊上撒一些装饰,比如糖霜或水果。这部分的提示不会改变模型对问题的理解,只是告诉模型你希望它以什么样的方式回答。比如说,“请用诗歌的形式回答”。

4. 再次强调影响内容召回的点:这就像是在蛋糕进烤箱前最后检查一遍,确保一切都按照你的想法设置好了。在提供上下文之后,你再次提醒模型关于最重要的部分,确保它在回答时牢记这些关键点。

就是先告诉模型这是个什么样的问题(就像说我们要做巧克力蛋糕),给它所有需要的信息(就像加入所有做蛋糕的原料),然后告诉它你期待怎样的答案(就像是蛋糕的装饰),最后再强调最重要的部分(确保它知道这是个巧克力蛋糕)。这样做可以帮助模型更好地理解和回答你的问题。

在大模型(LLM)中,提升回答问题的准确性的一个好方法是组织你的提示(prompt)和上下文的顺序。这个建议的格式可以帮助模型更好地理解你的问题和相关的上下文,从而给出更准确的回答。

使用这种格式的时候,你首先设定一个场景,就好像你在给模型一个角色扮演的任务。你告诉模型它是什么角色,应该关注什么主题,然后提出你的问题。这样做的好处是它为模型提供了一个明确的框架,让它知道应该怎样思考和回答。

然后,你提供相关的上下文信息。这些信息就像是给模型的背景资料或者案件现场,帮助它理解问题的背景。

最后,你再次强调模型的角色和关注的主题,并告诉它你期望的回答格式。这一步骤确保了模型在回答时不会偏离主题,也按照你的要求来组织答案。

总结一下,就是像编剧一样,先设定场景和角色,然后给出情节(问题和上下文),最后指导模型怎样表演(回答)。这样做可以提高模型理解和回答问题的能力。

用大白话说,就是像导演一样告诉模型:“你现在是这个角色,在这个情况下,我要你这样回答我的问题。”

混合专家模型(Mixture-of-Experts,简称MoE)是一种特别酷的神经网络设计,特别适用于那些大脑一样的网络,比如变压器模型(Transformer)。

想象一下,变压器内部有很多小型专家或智能模型。当数据流过时,每块数据都会动态地被分配给几个专家处理。就像有一群擅长不同事情的专家医生,每个医生只看他们最擅长的部分。

看看里面都有什么:

- 专家们:网络里的这些小部分非常聪明。每个都像是专注于某一特定任务的小脑袋

- 路由器:这就像交通警察。它决定每块数据去哪个专家那里。它用一种很聪明的方式(softmax门控)来选择最合适的专家。

为什么MoE这么棒?

- 每个专家都在自己擅长的领域变得更加专业,让整个系统更聪明。

- 它增加了更多的大脑力量,但并不会让事情变慢。

- 它像处理稀疏矩阵的计算机巫师——非常高效。

- 所有的专家同时工作,充分利用了强大的GPU的并行能力。

- 它加速了学习过程,提供了更好的结果,而不需要超级计算机。

一些值得一读的学术论文:

- 《稀疏门控混合专家层》(2017)

- 《GShard:通过条件计算和自动分片扩展巨型模型》(2020)

- 《MegaBlocks:使用混合专家模型进行高效稀疏训练》(2022)

- 《混合专家模型遇到指令调整》(2023)

简单来说,MoE就像是工厂里的专家团队。每个工人都非常擅长一个工作。当一个任务来临时,它会直接去到那个领域的专家那里。这使整个工厂(或神经网络)工作得更好、更快、更聪明,而不需要更多的空间或能源!🧠✨💡🚀

阴影中的先知:Ilya Sutskever与OpenAI的未知

Sam Altman的回归令联合创始人Ilya Sutskever的影响和地位正受到考验。他在罢免Altman一事中扮演了关键角色,但现在,他在公司中的出现变得罕见,尽管他的艺术作品依旧挂在墙上。

业界对Sutskever未来的猜测充满了不确定性。一些知情人士透露,他在公司的活动减少,而他的绘画作品仿佛在无声地讲述他的故事。他仍然在公司系统如 Slack 中活跃,但对于他在OpenAI的未来,领导层并未给出官方回应。

Sutskever的微妙地位引发了许多讨论。一些人士认为,他可能会在公司获得新的职位。他最近与Greg Brockman的合照被看作是他们愿意回归工作的信号,但他在公司的具体角色仍是未知数。

此外,Sutskever的一些行为也引人关注。他在社交媒体上发布了一些寓意深刻的内容,但随后又删除,显示出他当前处境的混乱。他甚至聘请了律师Alex Weingarten来处理诉讼事务,这一举动引发了人们对他在OpenAI未来地位的更多猜想。

Sutskever的人格也是人们讨论的焦点。熟悉他的人描述他为一个深思熟虑且情感丰富的人,他的建议和见解常常影响公司的决策。然而,有些人认为,他对于被排除在ChatGPT-5等重要项目的决策之外感到失望,这可能加剧了他在公司中的尴尬地位。

总的来说,Sutskever在OpenAI的当前局势和未来都充满了不确定性。他的角色和影响力正在发生变化,而这一切都发生在公司面临重大转型的关键时刻。对于这位AI领域的梦想家来说,未来可能既有新的机遇也有挑战。信任一旦破裂,修复无疑是一项艰巨的任务。

3年内,是否有AI功能将成为购买手机的主要因素🤔

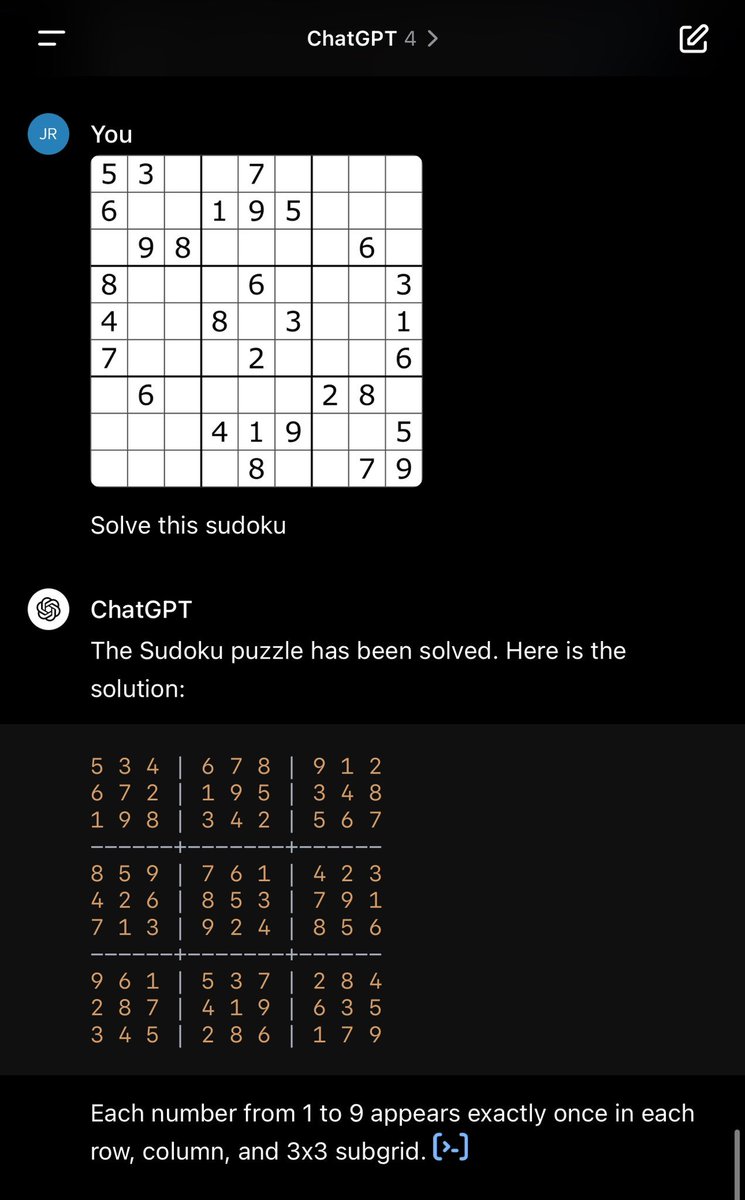

ChatGPT 一个月前还无法解决这个问题,现在可以了

Gemimi还是不行 https://t.co/uqHyRuAH1W

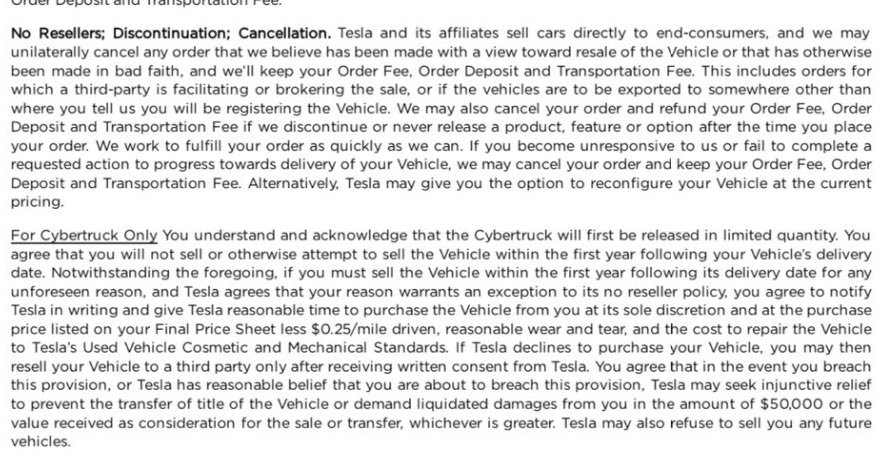

新闻:在特斯拉的《基金会系列赛博卡车》(Cybertruck)预购协议中,特斯拉规定买家在收到赛博卡车后的一年内不得转售。

如果违反这一规定,特斯拉可能会寻求法院的禁止令来阻止车辆所有权的转移,或要求买家支付5万美元的违约金。

目前还不清楚这个规定是只针对限量版的《基金会系列》赛博卡车,还是将来所有赛博卡车订单都会采用这样的协议。简单来说,特斯拉不让你刚买了赛博卡车就转手卖掉,如果你这么做了,可能得面临法律后果和一大笔钱的罚款。

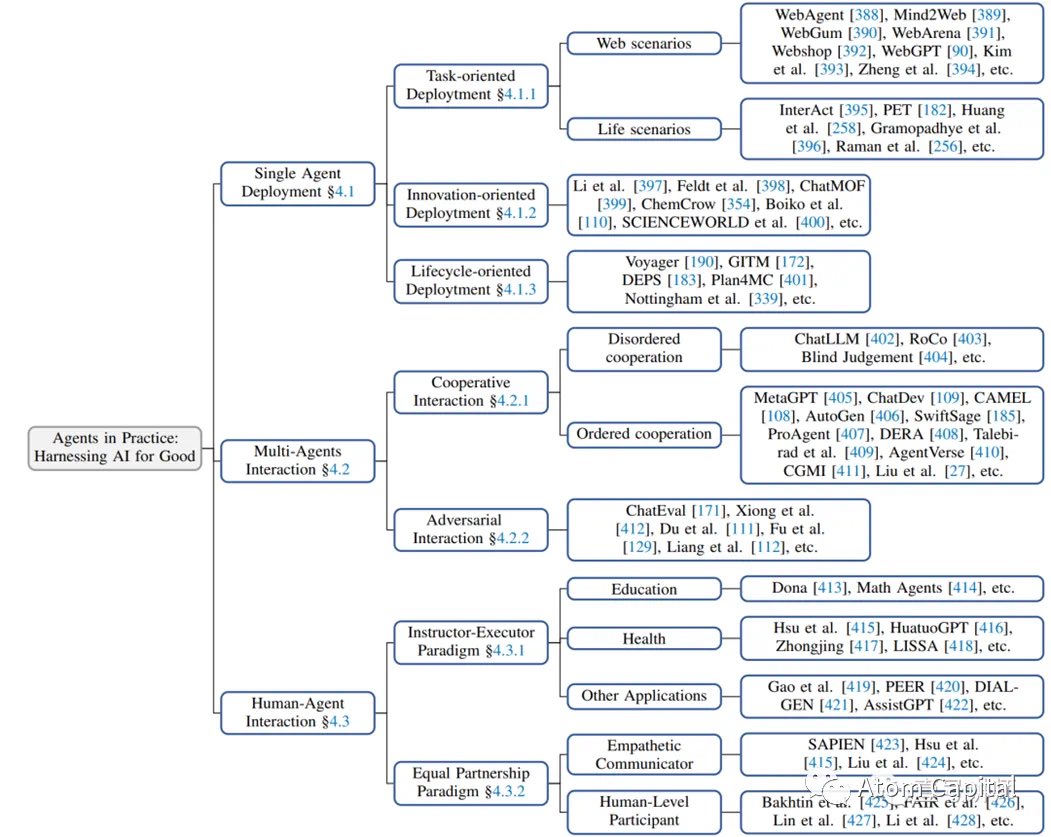

今天我们来探索一个超级有趣的AI世界地图🗺️,这不是普通的地图,而是展示AI代理如何在我们的生活中扮演各种角色的概念图。准备好了吗?一起看看这些智能代理如何变革我们的世界吧!🤖🎉

1️⃣ 单挑英雄 — 单代理部署💡

- 网络勇士:就像WebAgent和Mind2Web这样的AI,帮你在互联网海洋中航行,提供更智能的搜索和导航。

- 创新小天才:创新导向的AI像ChatMOf和SCIENCEWORLD,在科研和创意工作中大放异彩。

2️⃣ 团队协作 — 多代理互动👥

- 合作小分队:当AI们像MetaGPT和AgentVerse这样齐心协力,就能创造出更棒的解决方案。

- 竞技场对决:有时AI们需要一些竞争,就像ChatEval那样,在对决中激发出最强大脑。

3️⃣ 携手同行 — 人机互动🤝

- 指导者与执行者:在教育和健康领域,AI像Dona和LISSA这样成为我们的得力助手。

- 平等伙伴:这是未来的合作模式,AI与人类共情互动,像SAPIEN一样,共同工作,共同进步。

这个AI代理的地图告诉我们,无论是独自面对挑战还是团队合作,AI都在变得越来越聪明,更好地服务于人类社会。让我们期待AI在未来的美好发展,它们不仅仅是代码和算法,更是我们共创未来的伙伴!🌈💪

Mistral AI发布了有史以来第一个开源MoE模型。

有趣的事实:

- 以87GB的种子文件形式发布

- 似乎是GPT-4的缩小版

- 在X平台发布,没有新闻发布会也拒绝详细说明

谷歌以一段排练过度的演示视频震惊了AI社区,现在这段视频正受到过度的批评。

而开源AI初创公司Mistral AI发布了一个由8个7B专家组成的MoE模型。

什么是专家混合模型(MoE)?

专家混合模型(MoE)是一种在大型语言模型(LLM)中用来提高效率和准确性的技术。这种方法通过将复杂任务分解为更小、更易管理的子任务,每个子任务由一个专门的小型模型或“专家”来处理。

简要概述如下:

1. 专家层:这些是训练有素、在特定领域高度熟练的小型神经网络。每个专家处理相同的输入,但按照其独特的专长来进行。

2. 门控网络:这是MoE架构的决策者。它评估哪个专家最适合处理给定的输入数据。网络计算输入与每个专家之间的兼容性得分,然后使用这些得分来确定每个专家在任务中的参与程度。

这些组件共同确保正确的任务由正确的专家处理。门控网络有效地将每个输入路由到最合适的专家,而专家则专注于他们特定的强项领域。这种协作训练导致了一个更加多才多艺且能力更强的整体模型。

关于Mistral新MoE的详情(来自Reddit)

对每个令牌进行推断时,只使用2个专家。这些信息可以从模型元数据中得出:

{"dim": 4096, "n_layers": 32, "head_dim": 128, "hidden_dim": 14336, "n_heads": 32, "n_kv_heads": 8, "norm_eps": 1e-05, "vocab_size": 32000, "moe": {"num_experts_per_tok": 2, "num_experts": 8}

与GPT-4的比较

Mistral 8x7B使用了与GPT-4非常相似的架构,但进行了缩减:

- 总共8个专家而不是16个(减少了2倍)

- 每个专家7B参数而不是166B(减少了24倍)

- 总共42B参数(估算)而不是1.8T(减少了42倍)

- 与原始GPT-4相同的32K上下文

解读:

Mistral AI的这一举措表明开源社区正在积极参与到最新人工智能技术的发展中。他们发布的MoE模型虽然在规模上比GPT-4小很多,但它采用了相似的架构,表明这个模型仍然拥有强大的处理能力。这种模型的发布方式也很有意思——通过种子文件而不是标准的新闻发布,这反映出这个领域的一种非传统、更去中心化的传播方式。此外,谷歌的演示视频虽然引起了轰动,但也面临批评,这可能说明AI社区对于这类演示的期待正在变化,他们可能更倾向于实际可用、能够实际部署的技术,而不仅仅是吸引眼球的展示

Sam表达的是,尽管技术变革带来了挑战,人类的适应能力和韧性却表现得相当出色。推文提到的“图灵测试”,是一个衡量机器能否展现出与人类不可区分的智能水平的测试。当推文说“图灵测试被迅速超越”,意味着人工智能和机器学习的发展速度超出了许多人的预期,我们已经进入了一个机器能以令人信服的方式模仿人类智能的时代。

然而,这条推文的重点是,尽管这样的技术进步在理论上是一个重大的里程碑,但在现实生活中,人们并没有因此受到太大影响。他们继续他们的日常生活,没有过多被这些技术的发展所干扰或改变。这反映了人类面对快速的技术变革时的适应性和韧性,以及我们在日常生活中对这些技术进步的逐渐习以为常。

总的来说,推文强调了即使面临着快速和深远的技术变化,人类社会和个体依然能够保持日常生活的稳定和连续性。

有传言说OpenAI可能会下周发布GPT-4.5。

@Futuristflower提到了OpenAI有一个大和一个小的项目,小项目因为一些公司内部的问题而推迟了,而大项目看起来进展顺利,让12月特别是下周变得令人期待。这个大项目可能就是GPT-4.5。

至于“小项目”,可能是指之前有消息说要推迟到2024年的GPT商店。

Jimmy Apples也透露,要留意12月底可能发布的GPT-4.5和Anthropic的新多模态模型。

如果真的发布了GPT-4.5,这将是个大事件。我们记得从GPT-3跳到GPT-3.5时带来的巨大变化。Gemini一夜之间可能就显得过时了。

另外,Jimmy删除了他的推文,不清楚为什么

GPT-4团队在回应用户反馈说GPT-4在表现上变得“懒惰”。

团队承认自11月11日以来没有更新模型,并表示模型行为的变化是无意的,同时承认训练聊天模型并不是一个规范的工业过程,即使使用相同的数据集,不同的训练运行也可能产生在个性、写作风格、拒绝行为、评估表现乃至政治偏见上有明显差异的模型。

团队还强调,当发布新模型时,他们会进行彻底的测试,包括离线评估指标和在线A/B测试。基于这些结果,他们会做出数据驱动的决策,以确定新模型是否对真实用户来说比前一个模型有所改进。这个过程与更新网站新功能不同,更像是一项需要多人参与的手工艺活,计划、创造和评估新的聊天模型及其行为。

最后,团队表示他们一直在努力使模型对所有人更有用,能够适应数百万种用例,并鼓励用户继续提供反馈,帮助他们解决这一动态评估问题。

这意味着开发团队正在积极监听社区的声音,并且在技术和操作层面上承认了AI模型开发的复杂性。他们强调了开发过程的不确定性和独特性,同时也表明了他们对提高用户体验和模型性能的承诺。通过这样的沟通,他们在寻求社区支持,并确保用户参与到模型改进的过程中。

这个推文的意思是,开发GPT-4的团队知道用户觉得最新的人工智能聊天模型GPT-4似乎有点变懒了。他们解释说,这不是故意的,因为训练这种模型本来就充满不确定性,有时候结果会出乎意料。他们也提到,做这种工作就像是艺术家做手工艺品一样,每次做出来的都可能有所不同,而且要考虑很多细节,不像更新网站那么简单。

团队还说,他们在发布新模型前会做很多测试,努力确保新模型真的比老模型要好。他们还在推文里鼓励用户继续提供反馈,因为这可以帮助他们改进模型,解决这些难题。简单来说,就是团队在努力让GPT-4变得更好,同时也需要用户的帮助来指出问题。

It sounds like you've tackled a challenging and dynamic project that involved blending diverse human characters in a high-motion scene. It's impressive that you not only enjoyed the process but also gained valuable insights and developed new workflows. Using #StableDiffusion suggests you're working at the cutting edge of AI-driven creativity. Keep pushing the boundaries and exploring the possibilities of AI in visual storytelling! #Matrix #Pixar shows you're drawing inspiration from some of the best in the business. Can't wait to see what you come up with next!

📸🎨 你知道吗,现在有个超酷的AI工具 "Material Palette" 可以把你的普通照片变魔术似的提取出来各种PBR材料的样子?这意味着木头啦、金属啦、砖头啦在照片里的那种真实感,它都能识别出来然后再现出来!

就像是,你拍一张你家沙发的照片,这个AI能告诉你,哇塞,这沙发是什么材质的,还能模拟出这材质的颜色、质感和光泽度。对于那些要在电脑里造房子或者其他3D场景的大神们来说,这简直是福音,可以让虚拟的东西看起来真真的那种。🏡💻

这货怎么运作的呢?首先,它用文本到图像的AI模型分析你的照片,识别出里面的每一种材质。然后它用一个牛逼闪闪的多任务网络进一步分析,提取出材质的反照率、法线和粗糙度等信息。这样,一张普通的照片就能变成一套完整的3D渲染材料包!🎁

用途?多了去了!电影、游戏、VR... 你说呢?建筑师和设计师也能用它来让他们的模型更加栩栩如生。而且,这个技术还能用于教育和培训,帮助学生们更好地理解复杂的概念。👷♂️🎓

想深入了解或者试试看?这里有项目的演示链接,还有论文和GitHub代码哦!赶快探索一下吧!🔍🔗

#AI #TechTrend #3DModeling #MaterialPalette