Sam关于最近OpenAI高层变动原因(全文)

大家好——

在过去的6年半里,Mira对OpenAI的进步和成长起到了关键作用;她在我们从一个默默无闻的研究实验室发展成一家重要公司过程中,发挥了极其重要的作用。

当Mira今天早上告诉我她决定离开时,我感到非常难过,但当然支持她的决定。在过去的一年里,她一直在培养一批优秀的领导者,他们将继续推动我们的进步。

我还想分享,Bob和Barret也决定离开OpenAI。Mira、Bob和Barret都是独立且友好地做出了这些决定,但由于Mira的决定使得我们现在可以一起进行这些交接,所以我们可以共同努力,顺利过渡到下一代领导层。

我对他们所有人的贡献深表感谢。

在OpenAI担任领导是一项全身心投入的工作。一方面,能够构建AGI并成为一家能将我们先进研究成果交到数亿人手中的快速成长公司是一种特权。另一方面,带领团队度过这一过程是非常辛苦的——他们为公司付出了远超职责要求的努力。

Mark将成为我们的新研究高级副总裁(SVP of Research),并将与Jakub作为首席科学家共同领导研究组织。这是我们长期以来为Bob计划的继任方案;虽然这发生得比我们预期得早,但我对Mark接任这个角色感到非常兴奋。Mark显然具有深厚的技术专长,而且在过去几年中,他以非常令人印象深刻的方式学会了如何成为一名领导者和经理。

Josh Achiam将担任新的使命对齐负责人(Head of Mission Alignment),在整个公司范围内工作,以确保我们所有环节(以及文化)正确无误,以便成功实现使命。

Kevin和Srinivas将继续领导应用团队。

Matt Knight将成为我们的首席信息安全官(Chief Information Security Officer),他已经在这个职位上服务了很长时间。这也是我们计划已久的安排。

Mark、Jakub、Kevin、Srinivas、Matt和Josh都将向我汇报。在过去的一年左右时间里,我大部分时间都花在了公司的非技术部分;现在我期待着把大部分时间花在公司的技术和产品部分。

...

领导层变动是公司发展的自然部分,尤其是那些增长如此迅速且要求如此高的公司。我显然不会假装这次变动如此突然是正常现象,但我们不是一家普通公司,我认为Mira向我解释的原因(永远没有一个好时机,任何不突然而渐进的变动都会泄露消息,她希望在OpenAI处于上升期时进行这次变动)是合理的。我们明天在全体员工会议上可以进一步讨论这件事。

感谢大家所有辛勤工作和奉献精神。

Sam

Llama Stack APIs:全面解析现代AI系统架构

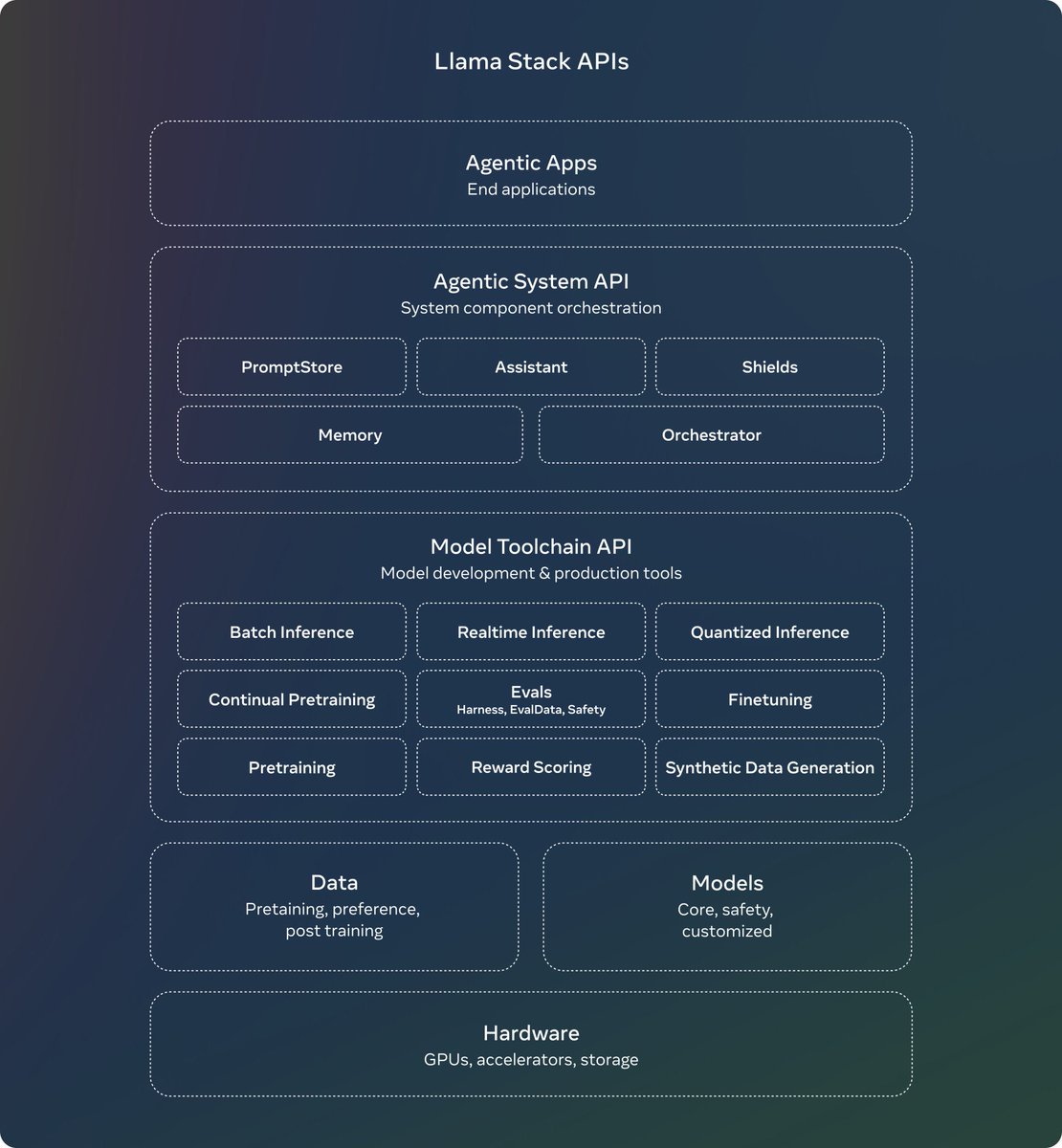

这张图展示了Llama Stack APIs的完整架构,涵盖了从硬件到应用程序的各个层级,为构建和部署AI模型提供了全方位的支持。

1. Agentic Apps(代理应用):

- 最终应用程序层,用于直接与用户互动。

2. Agentic System API(代理系统API):

- 系统组件编排,包括:

- PromptStore:提示存储

- Assistant:助手

- Shields:防护

- Memory:记忆模块

- Orchestrator:协调器

3. Model Toolchain API(模型工具链API):

- 模型开发和生产工具,包括:

- Batch Inference:批量推理

- Realtime Inference:实时推理

- Quantized Inference:量化推理

- Continual Pretraining:持续预训练

- Evals(Harness, EvalData, Safety):评估工具

- Finetuning:微调

- Pretraining:预训练

- Reward Scoring:奖励评分

- Synthetic Data Generation:合成数据生成

4. Data(数据):

- 包括预训练、偏好设置和后期训练的数据管理。

5. Models(模型):

- 包括核心、安全性和定制化模型。

6. Hardware(硬件):

- 包括GPU、加速器和存储设备,为整个系统提供计算能力。

这个架构展示了如何通过不同层级的API接口,实现高效、灵活且安全的AI系统开发与部署。

打造高效AI工作流:实时索引集成多平台数据

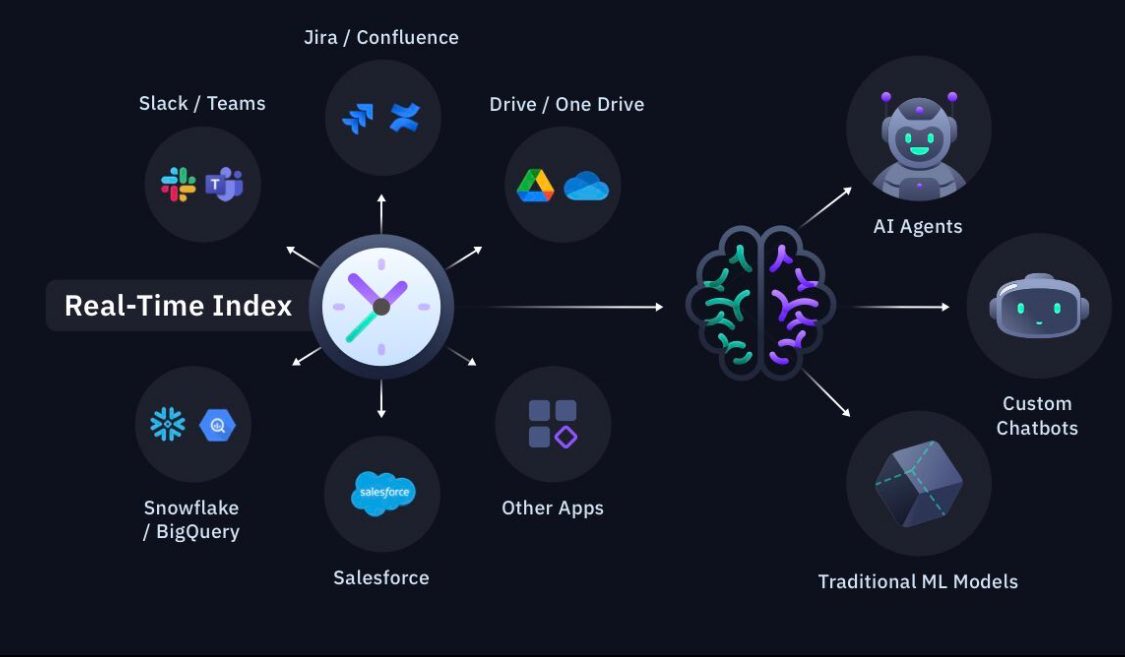

这张图展示了一个名为“实时索引(Real-Time Index)”的系统如何整合和处理来自多个应用程序的数据,进而为AI代理、定制聊天机器人和传统机器学习模型提供支持。

1. 数据来源:

- Slack / Teams:团队协作工具

- Jira / Confluence:项目管理和文档协作工具

- Drive / One Drive:云存储服务

- Snowflake / BigQuery:数据仓库解决方案

- Salesforce:客户关系管理(CRM)平台

- 其他应用(Other Apps)

2. 实时索引(Real-Time Index):

中心的时钟图标代表实时索引系统,它从上述各个数据来源获取信息并进行处理。

3. 输出结果:

处理后的数据被传送到以下几种用途:

- AI代理(AI Agents)

- 定制聊天机器人(Custom Chatbots)

- 传统机器学习模型(Traditional ML Models)

这个系统通过集成多个平台的数据,实现了信息的实时处理和智能应用,极大地提升了工作效率。

Barret Zoph,OpenAI副总裁(后期训练研究)(VP Research, Post-Training)宣布离开OpenAI

他的告别信如下:

大家好,我决定离开OpenAI。

这是一个非常艰难的决定,因为我在OpenAI度过了一段非常精彩的时光。我在ChatGPT推出前加入了公司,并与John Schulman等人一起从零开始建立了后期训练团队。我非常感激有机会领导这个团队,并帮助将ChatGPT发展到今天的规模。现在感觉是时候去探索OpenAI之外的新机会了。这是一个基于我个人职业生涯下一阶段发展的决定。

我非常感谢OpenAI给我的所有机会,以及来自OpenAI领导层如Sam和Greg的支持。我特别感谢Bob为我所做的一切,他在我的OpenAI职业生涯中一直是一个优秀的经理和同事。后期训练团队有许多才华横溢的领导者,他们将会把团队带向更好的未来。

OpenAI正在并将继续进行令人难以置信的工作,我对公司的未来充满乐观,并会继续为大家加油打气。

🚨Bob McGrew,OpenAI担任首席研究官(Chief Research Officer)宣布离开OpenAI😿

他的告别信如下:

过去八年在OpenAI的经历既令人谦卑又充满敬畏。我在2017年1月加入的这个小型非营利组织,现已成为世界上最重要的研究和部署公司。

我非常享受与一群才华横溢、全心投入的同事们一起工作——世界上没有其他地方能像这里一样。对于我们的研究团队这些年来所做的工作,我感到无比自豪,从我们早期在强化学习(RL)方面的成就,到开创大型语言模型(LLM),再到构建第一个多模态生成模型,并通过ChatGPT改变世界。

现在是我休息的时候了。没有比向世界推出o1更好的结束我在这里工作的方式了。

展望未来,Mark Chen将作为高级副总裁领导研究团队,Jakub将担任首席科学家。在接下来的两个月里,我会继续支持Mark、Jakub和团队的过渡工作。我对他们的领导力充满信心,相信他们能够将OpenAI的研究推进到通用人工智能(AGI)及更远。我迫不及待地想看看这个团队接下来会做些什么。

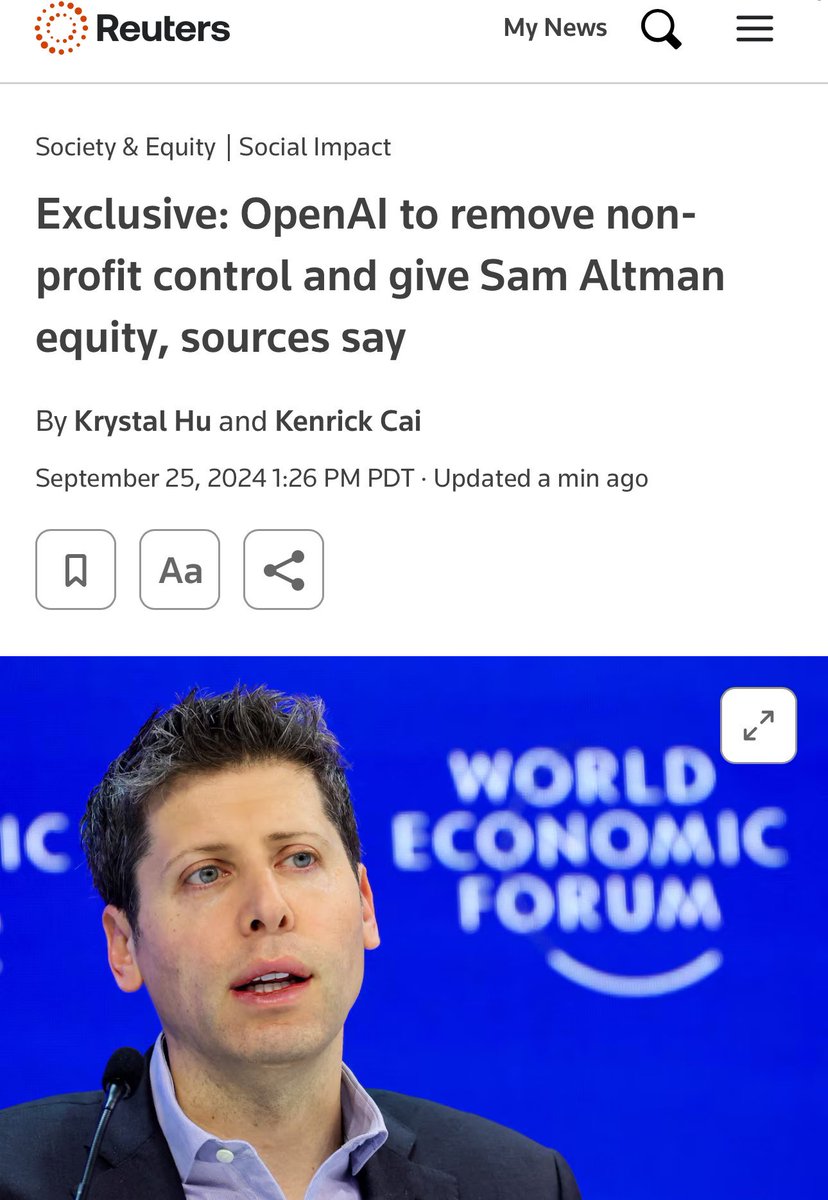

🚨 震惊!OpenAI 移除了非营利限制。

给Sam Altman 1500亿美元股份💸。前CTO Mira Murati辞职,看来连她也受不了这种操作了。🙄 https://t.co/KZXgR8ynvy

打破人类监督的桎梏:提高AI推理能力的科学探索

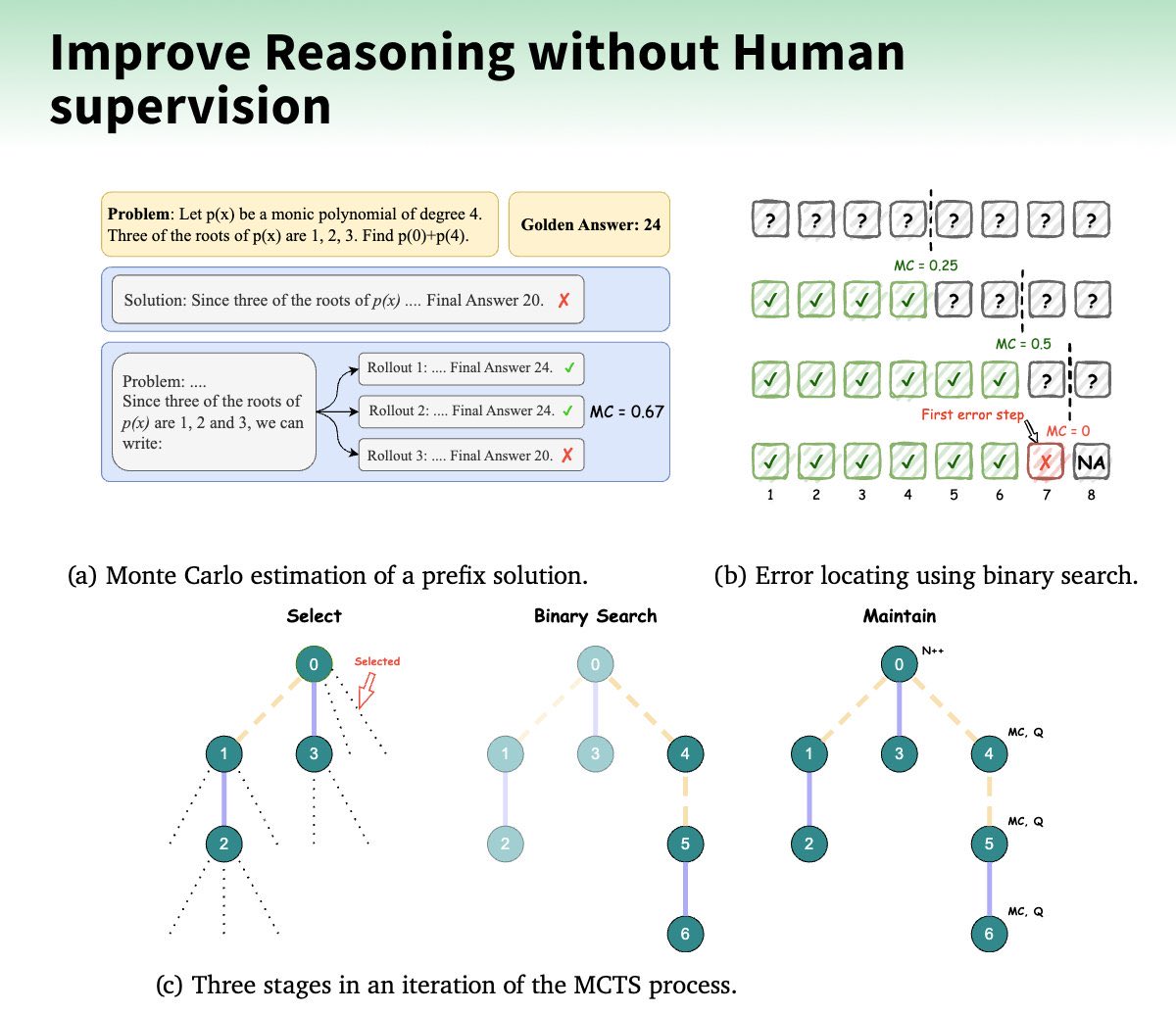

这张图表展示了如何通过无监督学习方法提升人工智能(AI)的推理能力。整个过程分为三个主要部分:

1. 问题定义与解决方案评估:

- 问题描述:给定一个四次单项式 \( p(x) \),已知其三个根为1、2和3,要求找到 \( p(0) + p(4) \) 的值。

- 黄金答案:正确答案是24。

- 解决方案评估:通过多次尝试(Rollout)得出不同的结果,并用Monte Carlo方法估算其正确性。

- 第一次尝试得到正确答案24。

- 第二次尝试再次得到正确答案24。

- 第三次尝试得到错误答案20。

2. 错误定位:

- 使用二分搜索法来定位错误步骤。

- 通过逐步检查每个步骤的Monte Carlo值来识别第一个出错的步骤。例如,第7步被识别为错误步骤,其Monte Carlo值为0。

3. 蒙特卡洛树搜索(MCTS)过程的三个阶段:

- 选择(Select):在搜索树中选择一个节点进行扩展。

- 二分搜索(Binary Search):利用二分搜索法在子节点中找到可能存在错误的位置。

- 维护(Maintain):根据Monte Carlo值和质量值 \( Q \) 来更新节点信息,以优化后续搜索。

- 无监督学习:减少对人类干预的依赖,使AI系统更加自主和高效。

- 准确定位错误:通过二分搜索法快速定位并修正错误,提高问题解决的准确性。

- 持续优化过程:利用蒙特卡洛树搜索持续优化决策过程,提升系统智能水平。

这种创新性的无监督学习方法,为AI推理能力的发展开辟了新的道路,展示了未来在更多复杂任务中实现更高自主性的潜力。

OpenAI的CTO和官方发言人Mira宣布离职并发布离职声明👇

最新消息:据路透社报道,OpenAI 将取消非营利董事会控制权,并将股权授予 Sam Altman

GPT-4o 演示的第二天,Ilya 宣布离职。

ChatGPT Voice 发布后的第二天,Mira 宣布离职。

OpenAI 那边发生什么事了? https://t.co/kNsnY4e6js

OpenAI o1速率限制提升解读

在OpenAI的服务中,速率限制(Rate Limit)是指在特定时间内允许的API请求次数。为了满足不同用户的需求,OpenAI设置了多个层级(Tier),每个层级对应不同的请求速率。以下是对Tier 5和Tier 4的详细解读:

Tier 5:

- o1-preview:每分钟允许5,000个请求。这意味着在这个层级,用户可以在一分钟内发送最多5,000个请求,适合需要高频率交互的应用场景。

- o1-mini:每分钟允许10,000个请求。这个速率更高,适合对请求量有极高需求的用户或应用,能够支持更大规模的操作。

Tier 4:

- o1-preview:每分钟允许1,000个请求。相比Tier 5,Tier 4的请求限制较低,适合中等需求的用户。

- o1-mini:每分钟允许5,000个请求。虽然请求量低于Tier 5,但仍然提供了相对较高的请求速率,适合大多数常规应用。

总结

据https://t.co/St5O59mmxt分析,不同的层级和请求速率为用户提供了灵活的选择。用户可以根据自身的需求选择合适的层级:

- Tier 5适合需要高请求频率、高并发操作的大型应用和企业用户。

- Tier 4则适合需求相对较低但仍需要较高频率访问的小型应用或中等规模企业。

通过合理选择层级和管理API调用频次,用户可以最大限度地利用OpenAI提供的资源,实现更高效、更稳定的服务体验。

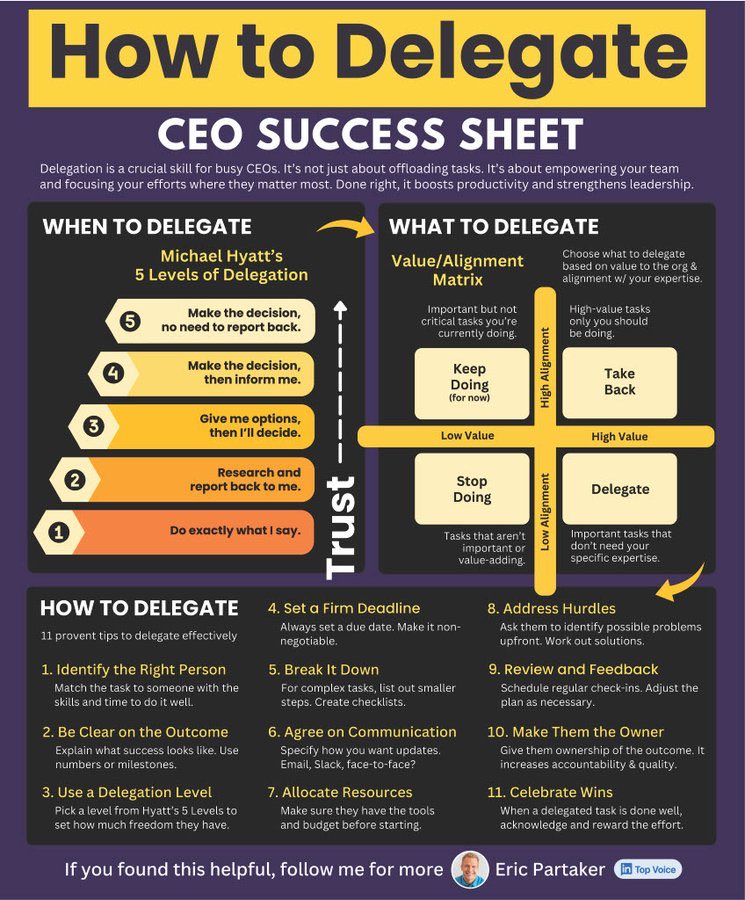

掌握高效授权:CEO成功的关键指南

这张图表详细解释了如何有效地进行任务授权,以提升生产力和加强领导力。图表分为三个主要部分:

1. 何时授权:

- 采用Michael Hyatt的五个授权级别,从完全控制到完全信任。

- 级别1:严格按照指示执行。

- 级别2:进行研究并汇报。

- 级别3:提供选项,由领导者决定。

- 级别4:决定后汇报。

- 级别5:自主决策,无需汇报。

2. 授权什么任务:

- 使用价值/对齐矩阵来确定哪些任务应该被授权。

- 高价值且高度对齐的任务应由领导者亲自处理。

- 高价值但低度对齐的任务可以授权给他人。

- 低价值但高度对齐的任务暂时继续进行。

- 低价值且低度对齐的任务应停止进行。

3. 如何有效授权:

- 提供11条实用建议,确保任务顺利下放并成功完成:

1. 找到合适的人选。

2. 明确预期结果。

3. 使用适当的授权级别。

4. 设置明确的截止日期。

5. 将复杂任务分解成小步骤。

6. 明确沟通方式和频率。

7. 分配必要资源。

8. 确认潜在障碍并解决问题。

9. 定期评审与反馈。

10. 给与被授权者成果所有权,增加责任感和质量保障。

11. 庆祝成功完成的任务,给予认可和奖励。

通过这些策略,CEO可以更好地分配时间和资源,专注于战略性工作,同时赋能团队成员,提高整体效率。

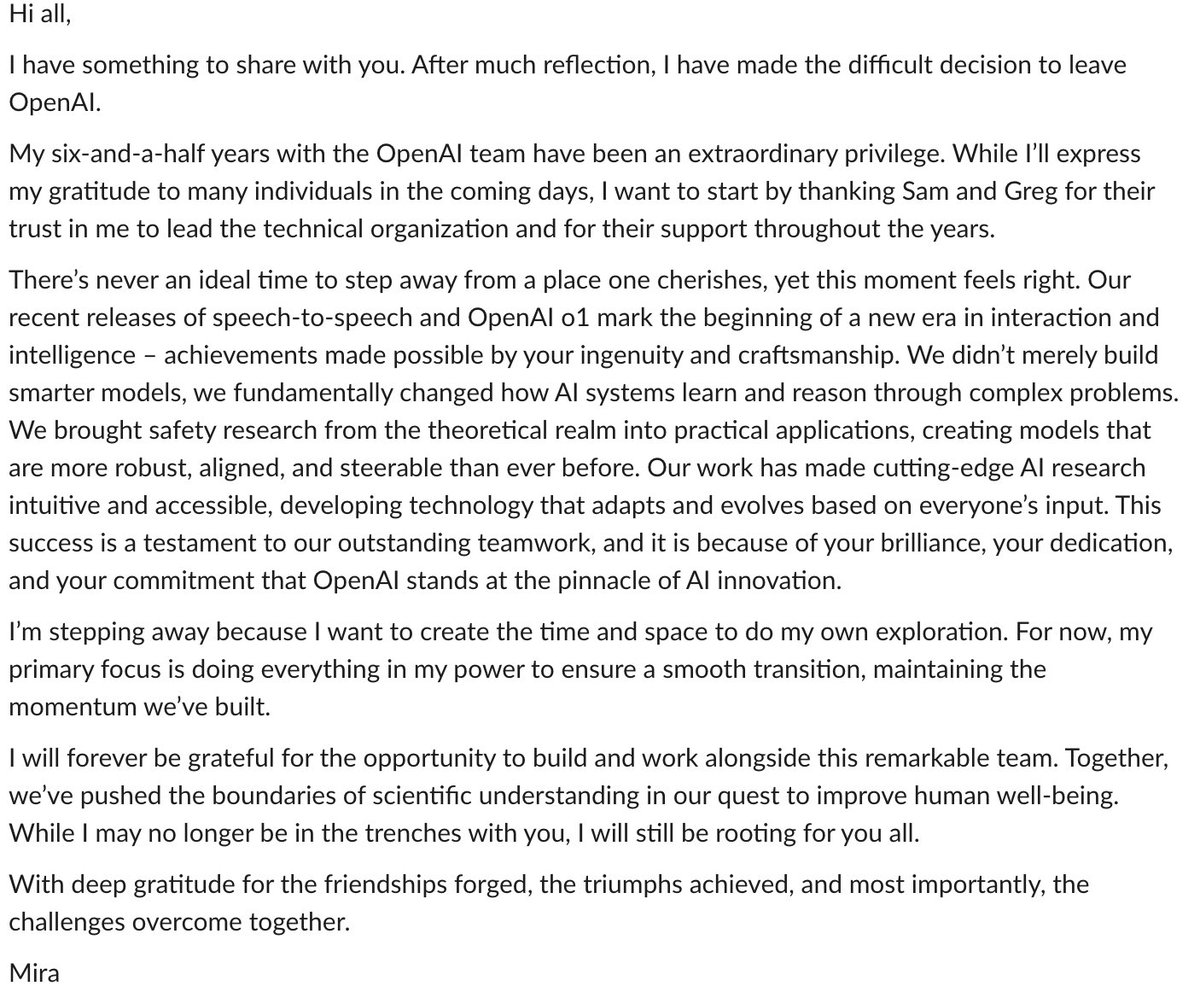

OpenAI CTO Mira Murati离职:告别信中透露的深情与未来计划(全文)

大家好,

我有一件事要与大家分享。经过深思熟虑,我做出了一个艰难的决定——离开OpenAI。

在OpenAI团队工作的六年半时间里,是一种非凡的荣幸。在未来几天里,我会对许多人表达我的感激之情,但我想先感谢Sam和Greg对我的信任,让我领导技术组织,并在这些年里给予我的支持。

没有一个理想的时机离开一个自己珍视的地方,但此刻感觉是对的。我们最近发布的语音到语音技术和OpenAI o1标志着交互和智能领域的新纪元——这些成就源于你们的智慧和精湛技艺。我们不仅仅构建了更智能的模型,更是从根本上改变了AI系统学习和解决复杂问题的方式。我们将安全研究从理论领域带入实际应用,创建了更稳健、对齐且可控的模型。我们的工作使尖端AI研究变得更加直观和易于使用,开发出基于每个人输入而不断适应和演变的技术。这一成功证明了我们出色的团队合作,也因为你们的才智、奉献和承诺,使OpenAI站在了AI创新的顶峰。

我离开的原因是为了创造时间和空间进行自己的探索。目前,我主要关注的是尽一切努力确保顺利过渡,保持我们已经建立起来的势头。

我将永远感激有机会与这个卓越的团队一起建设和工作。我们共同推动了科学理解边界,以改善人类福祉。虽然我可能不再与你们并肩作战,但我依然会为你们加油打气。

对于建立起来的友谊、取得的成就,尤其是共同克服的挑战,我怀着深深的感激之情。

Mira

😱OpenAI CTO震撼离职:Mira Murati宣布退出,团队未来走向何方

Mira Murati,OpenAI的首席技术官(CTO),在这封告别信中宣布离职。她回顾了自己在OpenAI度过的六年半时间,表达了对团队和领导的感谢,并指出她离开是为了追求个人探索。以下是解读的几个关键点:

1. 职业旅程与感恩:

- Mira提到在OpenAI工作的六年半是一段非凡的经历,并特别感谢Sam和Greg对她的信任和支持。

2. 公司成就与团队贡献:

- 她提到最近发布的语音转语音技术和OpenAI o1标志着交互和智能领域的新纪元。

- Mira强调团队不仅仅是构建了更智能的模型,更是根本改变了AI系统学习和解决复杂问题的方式。

- 安全研究从理论转向实际应用,创建出更稳健、对齐且可控的模型。

- 她对团队在推动尖端AI研究方面所做出的贡献表示高度赞赏,并认为这些成功归功于团队的卓越合作。

3. 离职原因与未来计划:

- Mira离职是为了创造时间和空间进行个人探索,目前她主要关注确保顺利过渡并保持现有势头。

4. 对未来的祝福:

- 她表达了对曾经合作过的机会以及团队成员深深的感激之情,认为他们共同推动了科学理解的边界以改善人类福祉。

- 虽然她不再与团队并肩作战,但仍会一直支持他们。

5. 总结与感谢:

- 最后,Mira以深深的感激之情回顾了他们共同建立的友谊、取得的成就以及克服的挑战。

整体来看,这封信充满感激与自豪,同时也传达了Mira对未来个人探索的期待。她对团队和公司的高度评价以及对未来发展的祝福,为她在OpenAI画上了一个圆满的句号。

打工人的财富自由梦:为何始终遥不可及?

人人都渴望实现财富自由,但现实似乎不那么友好。根据全球数据,74%的亿万富翁都是通过创业实现的,比如埃隆·马斯克这样的传奇人物。创业显然是通往财富的主要途径。

与此同时,还有30%的富翁是通过继承获得财富,17%是凭借投资眼光独到,而12%则是在担任首席执行官时积累了巨额财富,比如苹果公司的蒂姆·库克。运动员和艺术家也在这条金字塔上占据一席之地。

那么问题来了:为什么0%是打工人?显然,单靠打工无法致富。然而,许多人即使口头上渴望财富自由,却依然选择将大部分时间投入到打工生活中。

或许,这背后隐藏着对创业风险的恐惧、不确定性带来的压力,以及缺乏对财务管理的深入理解。但无论如何,如果你真的想实现财富自由,走出舒适圈、探索新的可能性或许才是关键所在。

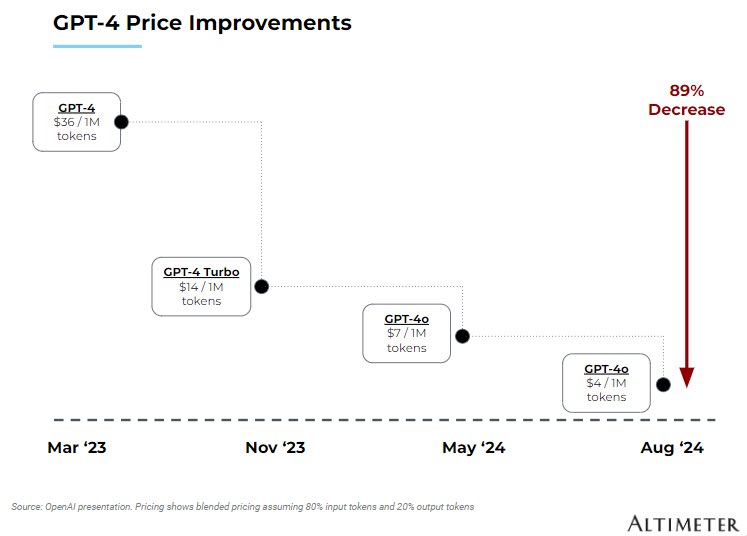

GPT-4推理价格暴跌89%!商业模式即将颠覆!

据https://t.co/St5O59mmxt分析,自GPT-4系列模型发布以来,其推理定价已下降近90%。以下是这一趋势的具体解读:

1. 价格变化概览:

- 2023年3月,GPT-4的推理成本为每百万tokens 36美元。

- 到2023年11月,GPT-4 Turbo将价格降低至每百万tokens 14美元。

- 2024年5月,GPT-4o进一步降价至每百万tokens 7美元。

- 最终在2024年8月,GPT-4o的价格降至每百万tokens 4美元。

2. 未来趋势与影响:

- 商业模式变革:随着推理成本的大幅降低,许多目前不可行的商业模式将变得可行。企业将能够以更低的成本使用先进的AI技术,从而推动创新和新应用的出现。

- 潜在需求释放:低廉的价格将使更多企业和开发者能够负担得起使用GPT-4系列模型,这将释放大量潜在需求。AI的普及速度将显著加快,各行各业将开始探索如何利用这些技术来提升效率和创造价值。

具体应用场景

1. 小型创业公司:可以以更低成本使用先进AI技术进行产品开发和市场预测,从而更好地与大公司竞争。

2. 教育领域:学校和在线教育平台可以利用便宜的AI进行个性化教学和智能辅导,提高学生学习效果。

3. 医疗行业:医院和诊所可以以较低成本使用AI进行病情分析和诊断辅助,提升医疗服务质量。

总之,GPT-4推理价格的大幅下降不仅是技术进步的体现,更预示着未来商业模式的重大转变。各行业将在这一趋势下迎来前所未有的发展机遇。

🚨 劲爆小道消息:OpenAI正在秘密训练新版本的Sora,目标是快速生成更高质量、更长时长的视频剪辑,超越之前的演示效果!😱 令人难以置信的是,公众连旧版本都没机会体验,现在他们竟然已经在研发新模型了!🙄 这到底是要给谁留机会呢?保持关注,更多内幕即将揭晓! https://t.co/pTcfadiJrJ

🚀 重磅推出:Meta Orion最新AI眼镜! 🌟

准备好迎接可穿戴技术的未来吧!🎉 Meta全新小型眼镜Orion震撼登场,带来前所未有的创新体验:

1. 独立运行 📱❌:无需连接其他设备,自由畅享科技魅力!

2. 眼动追踪 👀✨:视线即为指令,畅玩增强现实与游戏世界!

3. 手势识别 🙌🔄:挥挥手就能操控,告别物理按钮的束缚!

4. 神经追踪 🧠🔍:感知你的意图,开启无缝人机互动新时代!

这些特性不仅让Orion在技术上领先一步,也为未来可穿戴设备的发展指明了方向。🎯 无论是娱乐、教育还是健康管理,这款眼镜都将带来革命性改变。对于科技爱好者而言,这是体验数字与现实交融的绝佳机会!🌐✨

MetaOrion 创新科技 未来已来

震撼来袭!Llama Multimodal即将登场,开源社区迎来新纪元!

Meta再次展现其对开源的坚定承诺,推出了多模态模型Llama Multimodal,这无疑是开源社区的一大福音。下面详细解读一下图中的内容:

模型对比

图表展示了不同模型在多个基准测试中的表现,包括Llama 3.2 11B、Llama 3.2 90B、Claude3-Haiku和GPT-4o-mini。这些基准测试覆盖了数学推理、图表理解、视觉问答等多种任务。

各项测试成绩

1. College-level Problems and Mathematical Reasoning

- MMMU (Micro avg accuracy): Llama 3.2 90B得分最高,达到60.3。

- MMMU-Pro, Standard: Llama 3.2 90B依然领先,得分45.2。

- MMMU-Pro, Vision: GPT-4o-mini以36.5的得分略胜一筹。

- MathVista: Llama 3.2 90B得分57.3,表现最佳。

2. Charts and Diagram Understanding

- ChartQA: Llama 3.2 90B以85.5的高分领先。

- AI2 Diagram: Llama 3.2 90B再度拔得头筹,得分92.3。

- DocVQA: Llama 3.2 90B得分90.1,表现突出。

3. General Visual Question Answering

- VQAv2 (Image): Llama 3.2 90B得分78.1,再次领先。

4. Text-Based Tasks

- General VQAv2: Llama 3.2 90B表现最优,得分86。

- Math VQAv2: GPT-4o-mini以70.2的高分位居第一。

- Reasoning VQAv2: Llama 3.2 90B得分46.7,再次领先。

- Multilingual VQAv2: GPT-4o-mini以87的高分夺冠。

总结

从整体表现来看,Llama系列尤其是Llama 3.2 90B在多个基准测试中表现出色,显示了其强大的多模态处理能力。Meta的这一创新不仅填补了开源社区在多模态模型方面的空白,也为未来的研究和应用提供了坚实的基础。让我们一起期待Llama Multimodal为我们带来更多惊喜吧!