有些人天生不具备同理心,习惯随意伤害别人,这可以从大脑的生理结构和功能来解释。主要涉及两个重要区域:杏仁核和额叶。

杏仁核的作用

1. 情绪处理中心:杏仁核是大脑中负责情绪处理的核心区域。当我们面对危险或感受到情绪刺激时,杏仁核会迅速激活。这种快速反应有助于我们在紧急情况下做出“战斗或逃跑”的决定。

2. 同理心的缺乏:对于那些习惯伤害他人的人来说,他们的杏仁核可能处于关闭或低活跃状态。这意味着他们在面对他人痛苦时,不会产生强烈的情绪反应,从而缺乏同理心。

额叶的作用

1. 高级认知功能:额叶是负责决策、计划和社会行为控制的区域。当杏仁核发出情绪信号时,额叶会评估情境并做出适当的反应。额叶的健康功能有助于我们理解和回应他人的情感。

2. 道德和自我控制:额叶不活跃或功能不全的人,往往缺乏自我控制和道德判断能力。这意味着他们更可能做出冲动和伤害他人的行为,因为他们无法充分评估行为的后果。

综合分析

这种生理上的差异解释了为什么有些人似乎天生就更容易伤害他人,而不感到任何内疚或悔恨。了解这一点可以帮助我们更好地理解并处理这些行为模式在社会中的影响。

嘿,大家快来看!Sam的这张照片里竟然有五颗草莓🍓🍓🍓🍓🍓,这可是预示着GPT-5.0即将到来啊!😆😆😆😆😆 你们有没有发现更多细节呢?快来评论区分享一下你的发现吧! https://t.co/JZb5AAoFUE

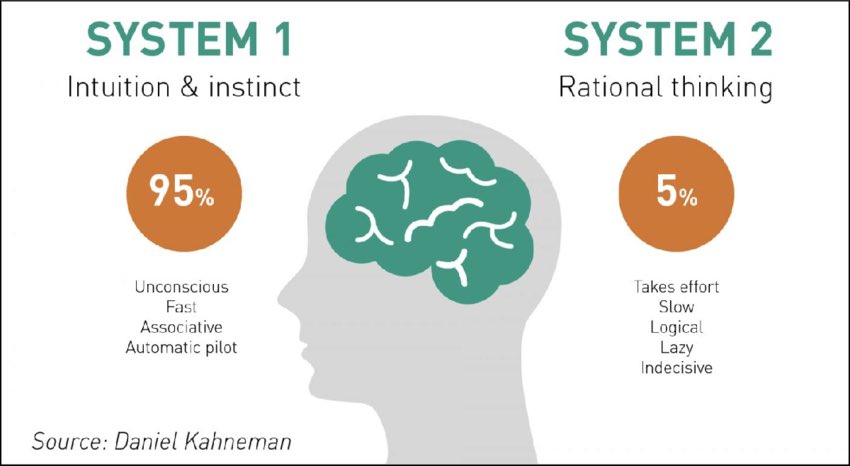

探索慢思考:AI System 2 研究合集

AI System 2 -慢思考研究合集

著名心理学家丹尼尔·卡尼曼 (Daniel Kahneman) 在他的著作《Thinking, Fast and Slow》中提出了两种思考模式的理论框架:

1. System 1:快速、直觉性的思考方式,它包括我们的直觉、情感反应、习惯和即时判断。比如你在看到一只老虎时立即感到恐惧,这是System 1在起作用。

2. System 2:缓慢、逻辑性和分析性的思考方式,它涉及复杂的计算、规划、专注和决策。比如你在计算一个复杂的数学题时,需要集中注意力和逻辑推理,这时System 2在工作。

System 2 Research 开源项目

该项目主要涵盖了AI LLM推理和认知相关的书籍、论文、博客文章、开源项目等,主题包括:

- AI Agents:自主智能体的研究和开发。

- Prompt Engineering:如何有效地向AI模型提出问题。

- 搜索方法:如何优化AI的搜索和查询能力。

- 认知架构:模拟人类思维和认知过程的架构。

- AI 软件工程:开发和维护AI系统的最佳实践。

推荐查阅资源

该项目的资源适合对AI和认知科学感兴趣的人,以下是一些主要贡献者:

- Andreas Köpf @neurosp1ke

- Yulong Wang @Ag2_S1

- Ömer Kaya @andthattoo

- Mohammed Hamdy @mhamdy_res

- Jackmin @jackmin

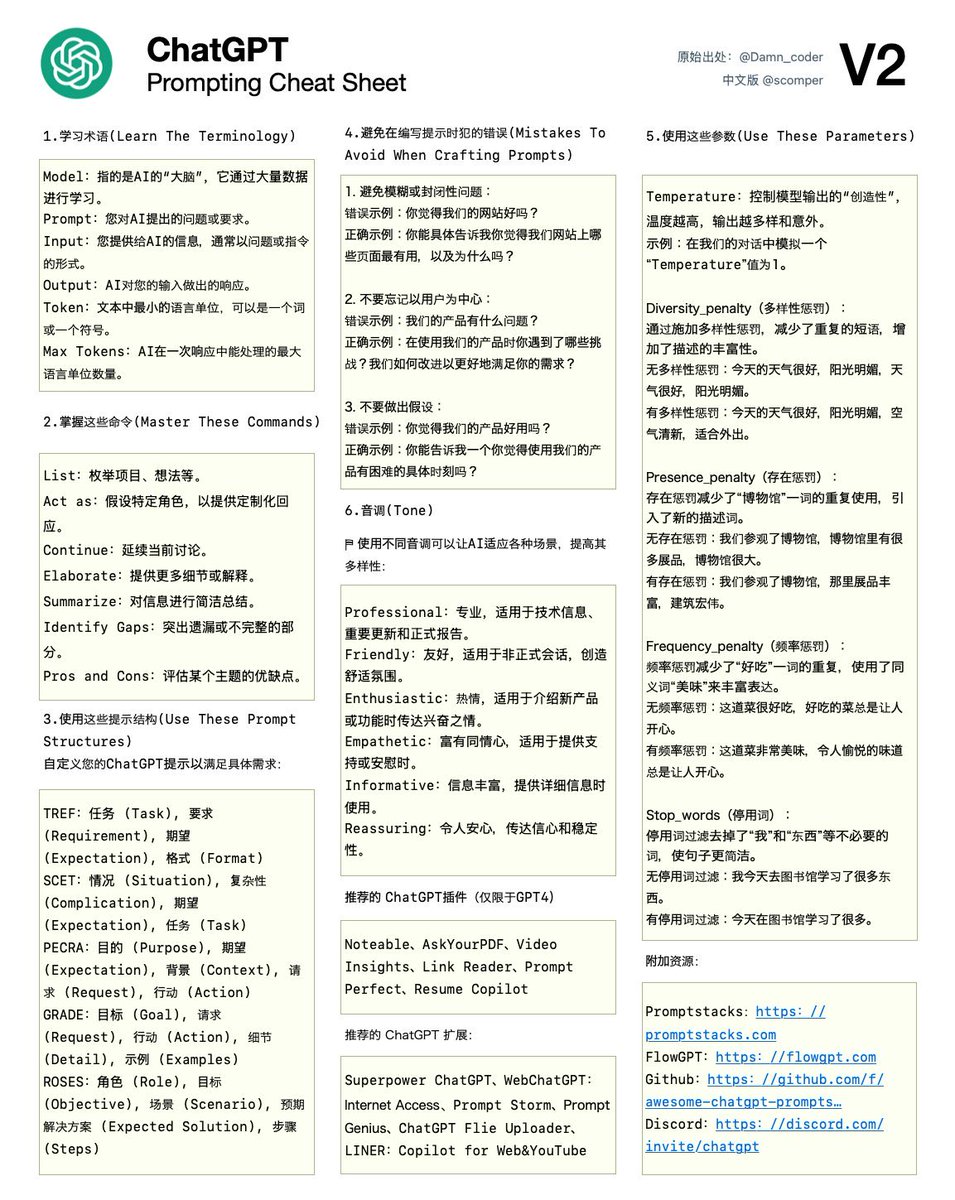

Mastering ChatGPT: A Practical Guide to Effective Prompting"

这张图展示的是如何有效使用ChatGPT进行提示和命令的指南。我们逐条详细解读每一条,并通过具体场景来说明。

1. 学习术语(Learn The Terminology)

- Model:指的是AI的“大脑”,它通过大量数据进行学习。例如,在日常生活中,你像是教一个小孩学会新的技能一样教AI。

- Prompt:是您对AI提出的问题或要求。比如你问AI一个问题,就像你向一个朋友寻求帮助。

- Input:您提供给AI的信息。比如,你告诉AI一段文字或一个问题。

- Output:AI对您的输入做出的反应或回答。就像朋友回答你的问题一样。

- Token:文本中最小的信息单元。比如,一个词或一个标点符号。

- Max Tokens:AI在一次响应中使用的最大令牌数量。想象一下,这是你和AI聊天时的一次最长对话长度。

2. 掌握这些命令(Master These Commands)

- List:创建一个项目列表。场景:让AI帮你列出需要买的杂货清单。

- Continue:继续AI的响应。场景:你打断了AI,让它继续刚才的故事。

- Elaborate:提供更多细节或解释。场景:你需要AI详细解释某个技术术语。

- Summarize:对信息进行简要总结。场景:你让AI帮你总结一篇长文章的主要内容。

- Identify Gaps:发现信息中的不足之处。场景:你请AI找出你研究报告中的缺陷。

- Pros and Cons:评估某个主题的优缺点。场景:你让AI帮你分析某个投资项目的优缺点。

3. 使用提示结构(Use These Prompt Structures)

- TREF:任务、要求、解释、格式。例如:你让AI解释如何烹饪一道菜,并给出步骤和图片。

- PERCA:目的、期望、上下文、行动。例如:你让AI帮你写一篇文章的结构。

- GRADE:目标、请求、行动、细节。例如:你让AI帮你设计一个项目计划。

- SCOPE:场景、挑战、机会、解决方案。例如:你请AI分析一个商业机会,并提出建议。

4. 避免在编写提示时犯的错误(Mistakes To Avoid When Crafting Prompts)

- 避免模糊或过度复杂的提示。正确示例:你明确告诉AI需要什么样的信息和格式。错误示例:你给AI的指令含糊不清,导致结果无法使用。

- 不要忘记设定具体的目的和目标。正确示例:你清楚地告诉AI你希望它完成的任务是什么。错误示例:你没有明确告诉AI任务的目标。

- 确保提示简洁明了。正确示例:你用简洁的语言告诉AI需要做什么。错误示例:你的指令冗长且复杂,AI难以理解。

5. 使用这些参数(Use These Parameters)

- Temperature:控制模型的“创造性”。较高的温度让AI生成更随机的输出,较低的温度生成更确定的回答。例如:你让AI创作一首诗,可以设置较高的温度。

- Diversity_penalty:增加多样性惩罚,避免重复。例如:你让AI生成多个建议,可以设置较高的多样性惩罚。

- Presence_penalty:存在惩罚,用于降低AI重复使用某些词语的可能性。例如:你让AI写文章,避免过多重复词语,可以设置较高的存在惩罚。

- Frequency_penalty:频率惩罚,用于降低AI重复输出同样内容的可能性。例如:你让AI生成多个创意点子,可以设置较高的频率惩罚。

6. 调整语调(Tone)

- Professional:专业,用于技术信息。场景:让AI撰写商业报告。

- Friendly:友好,适用于社交对话。场景:让AI编写社交媒体帖子。

- Enthusiastic:热情,用于介绍新产品。场景:让AI撰写新品发布会的演讲稿。

- Empathetic:富有同情心,用于提供支持。场景:让AI回答客户服务问题。

- Informative:信息丰富,用于新闻报道。场景:让AI编写新闻文章。

- Reassuring:令人安心,用于给出建议。场景:让AI提供医疗建议。

通过掌握这些提示和命令,您可以更高效地使用ChatGPT,为您的工作和生活提供帮助和支持。

OpenAI正在牵头投资AI硬件初创公司Opal,参与6000万美元的B轮融资。

这次融资吸引了包括YouTuber MKBHD和Casey Neistat在内的投资者,Founders Fund和Kindred Ventures等现有投资者也参与其中。

Opal公司之前主要生产网络摄像头,但这次融资将用于开发由OpenAI模型驱动的新设备。OpenAI高管对此投资特别兴奋,因为这为在Opal设备中使用其语音AI模型提供了机会。Opal将与OpenAI研究人员密切合作,为各种设备创意制作原型,如桌面对讲机类设备,这将帮助人们集思广益、研究或为创意项目写作。

这次投资不仅展示了OpenAI在硬件领域的扩展,也表明AI在智能设备中的应用前景广阔。Opal计划在继续销售其现有产品的同时,通过引入AI技术,提升产品的智能化和多功能性,从而拓展其市场份额。

这一合作对Web3行业也有重要影响,因为智能设备的普及和AI技术的融合,将进一步推动去中心化技术的发展,为用户提供更智能、更便捷的操作体验。

美联储降息背后的真相:经济衰退即将来临?

美联储降息能否挽救即将到来的经济衰退?S Lombard经济学家Steven Blit警告称,如果不尽早采取行动,今年晚些时候美国进入衰退的可能性将高达75%!

Steven Blit指出,美联储如果不尽早采取行动,经济衰退的风险将大幅上升。当前的疲软数据虽然不是直接导致衰退的元凶,但会引发一系列连锁反应,使经济前景更加不确定。

1. 美联储降息计划:预计美联储在9月份降息50个基点,到年底可能累计降息100个基点。这一举措旨在通过降低借贷成本来刺激经济增长,但实际效果仍有待观察。

2. 衰退可能性:即便采取降息措施,今年晚些时候进入衰退的可能性依然高达75%。这意味着企业和消费者需要提前做好应对经济下行的准备。

3. 市场反应:市场对美联储政策的反应将直接影响投资者信心和市场走势。如果降息措施未能达到预期效果,市场可能会经历更大的波动。

面对高企的经济衰退风险,美联储的降息决策至关重要。然而,即便采取行动,衰退风险仍难以完全避免。各界需要密切关注政策动向和经济数据,做好应对各种可能性的准备。

macOS桌面版ChatGPT应用发布,开启多任务新体验!

好消息!macOS桌面版ChatGPT应用现已发布,让你体验更便捷的多任务处理。只需按下Option + Space快捷键,就能打开一个伴随窗口,轻松保持在前,方便你与其他应用程序同时工作。ChatGPT macOS 多任务处理

macOS桌面版ChatGPT应用现已推出,让你在使用其他应用程序时也能轻松访问ChatGPT。按Option + Space打开伴随窗口,即刻享受便捷的多任务体验!

快来试试吧,提升你的工作效率,从现在开始

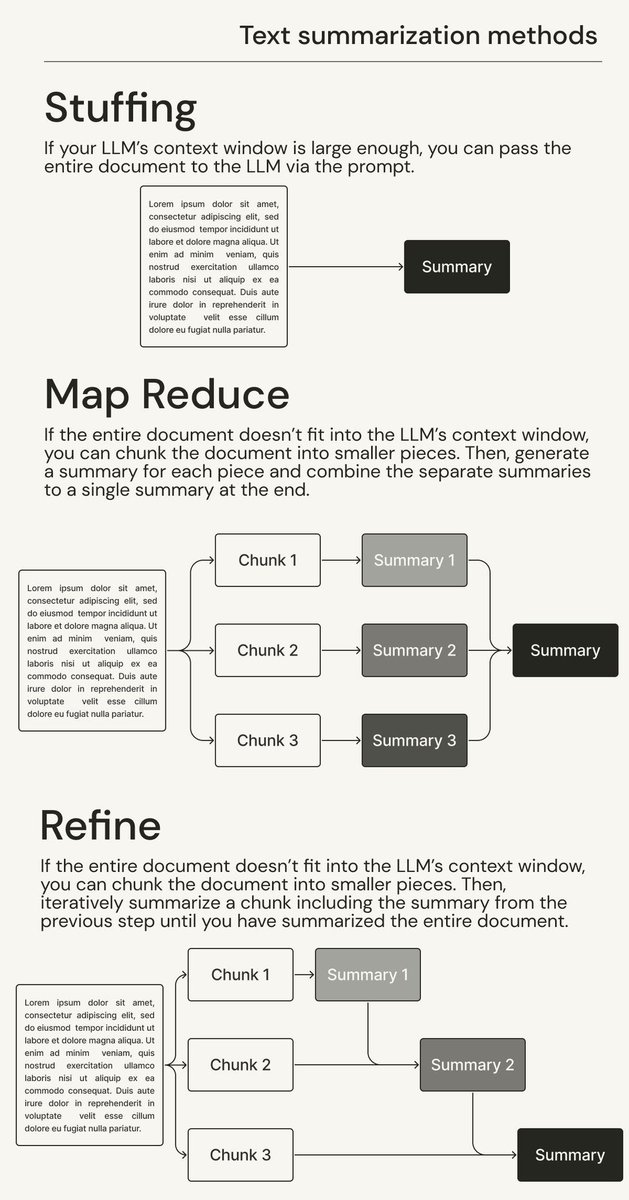

掌握文本总结的三种AI方法,提升工作效率!

想要提高文本处理的效率吗?看看这三种强大的文本总结方法吧!无论是短文档还是长篇大论,都能轻松应对。AI 文本总结 效率提升

Stuffing: 直接将整个文档传递给LLM,快速生成总结。

Map Reduce: 将文档分块处理,各块生成总结后再整合。

Refine: 分段总结并逐步细化,最终形成精炼摘要

这张图片展示了三种常用的文本总结方法,具体解释如下:

1. Stuffing(填充):

- 概念:将整个文档直接传递给大语言模型(LLM),让其生成总结。

- 适用场景:适用于文档长度在LLM上下文窗口容量范围内的情况。

- 例子:对一篇短新闻文章进行概括,比如一则关于最新科技发布的报道。

2. Map Reduce(映射减少):

- 概念:将文档拆分成多个小块,分别对每个小块生成总结,然后将这些总结组合成一个整体总结。

- 适用场景:适用于文档长度超出LLM上下文窗口容量的情况。

- 例子:对一本书的各章节进行逐一总结,最后汇总成一个整体总结,比如《哈利·波特》某一部的内容总结。

3. Refine(细化):

- 概念:将文档分成多个小块,逐步生成总结,每一步都在前一步总结的基础上进行细化。

- 适用场景:适用于需要精细总结且文档长度较长的情况。

- 例子:对一个复杂的技术文档进行分段总结,每段总结后进行进一步精炼,直到形成最终总结,比如对一份研究报告进行分段精炼总结。

---

举例场景:

1. 客户服务:

- 应用方法:Stuffing

- 场景描述:一名客服代表需要快速总结客户反馈,提供简洁明确的回应。将客户留言直接传递给LLM,生成一个简短的反馈总结。

2. 学术研究:

- 应用方法:Map Reduce

- 场景描述:一位研究员需要总结多篇研究论文的主要发现。将每篇论文分段处理,生成各段总结后,再将这些总结整合成一个全面的研究总结。

3. 法律分析:

- 应用方法:Refine

- 场景描述:律师需要对一份复杂的法律文件进行分析,生成精炼的法律摘要。将文件分成多个部分,逐段总结并细化,最终形成详细且准确的法律摘要。

手机端的「GPT-4V」来了!多模态理解能力登上新高度

近日,面壁小钢炮MiniCPM-V 2.6模型的发布,标志着端侧多模态理解能力的新突破

1. 模型概述:

- MiniCPM-V 2.6是面壁小钢炮系列的最新版本,具备8B参数。

- 它在单图、多图、视频理解三项核心能力上均取得了SOTA(State-of-the-Art,最先进技术)成绩,性能全面对标并超越GPT-4V。

2. 多模态功能:

- 单图、多图、视频理解:MiniCPM-V 2.6首次在端侧实现了这三种核心能力的全面超越。

- 实时视频理解:实现了端侧模型实时处理和理解视频内容的能力。

- 多图联合理解:包括多图OCR、多图ICL(In-Context Learning,情境学习)等功能,使得模型能够处理更复杂的视觉信息。

3. 技术优势:

- 高效低成本:MiniCPM-V 2.6延续了小钢炮系列以小博大与高效低成本的特点。它仅用8B参数就实现了超过20B模型的性能。

- 端侧友好:量化后端侧内存仅占6GB,推理速度达到18 tokens/s,相比上一代模型快33%。支持llama.cpp、ollama、vllm等多种推理方式,并且兼容多种语言。

4. 创新亮点:

- 最高多模态像素密度:MiniCPM-V 2.6在Token Density(单个token承载的像素密度)上取得了两倍于GPT-4o的成绩,显著提高了运行效率。

- 统一高清框架:OCR能力继续保持SOTA水平,并进一步覆盖了单图、多图、视频理解。

5. 开源与部署:

- MiniCPM-V 2.6开源地址:GitHub(https://t.co/EfaVyJJghG)和HuggingFace(https://t.co/WMJQPdrtqg)。

- 提供llama.cpp、ollama、vllm的部署教程,方便开发者快速上手。

面壁小钢炮MiniCPM-V 2.6的发布,不仅刷新了端侧多模态理解的天花板,也为未来AI应用在移动设备上的广泛普及铺平了道路。凭借其高效、低成本和强大的多模态处理能力,MiniCPM-V 2.6有望在各个领域展现其独特的优势。

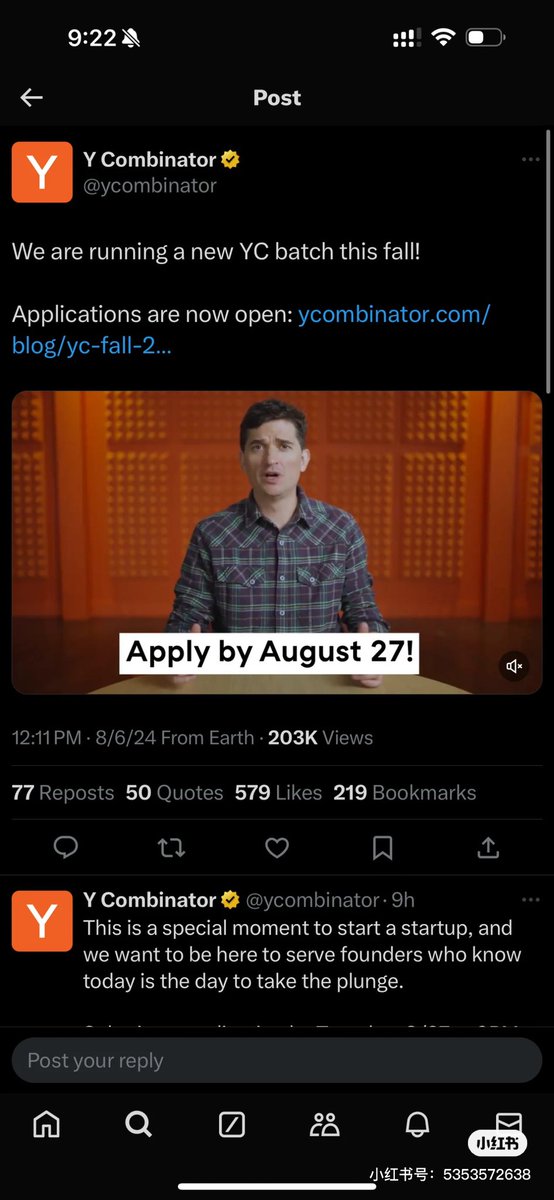

YC秋季计划正式启动,申请截止日期为8月27日!

Y Combinator(@ycombinator)在最新推文中宣布了2024年秋季计划的启动,并邀请有意的创业者在8月27日前提交申请。这个孵化器计划是全球创业者的梦想之地,帮助他们将创意转变为成功的企业。

除了宣布新的YC计划,Y Combinator还强调了这个时刻对于创业者的重要性,鼓励他们抓住机会,勇敢迈出创业的第一步:

Y Combinator(@ycombinator): 这是开始创业的特殊时刻,我们希望能帮助那些决定今天就要行动的创业者。

重点信息:

1. 秋季计划启动:YC秋季计划现已开放申请。

2. 截止日期:申请截止日期为2024年8月27日。

3. 申请链接:申请链接为https://t.co/jt6U0XcAeA。

创业者们,这是一个不容错过的机会!赶紧访问链接,提交你的申请,让Y Combinator助你实现创业梦想。8月27日是最后的机会,抓住它,开启你的创业之旅!

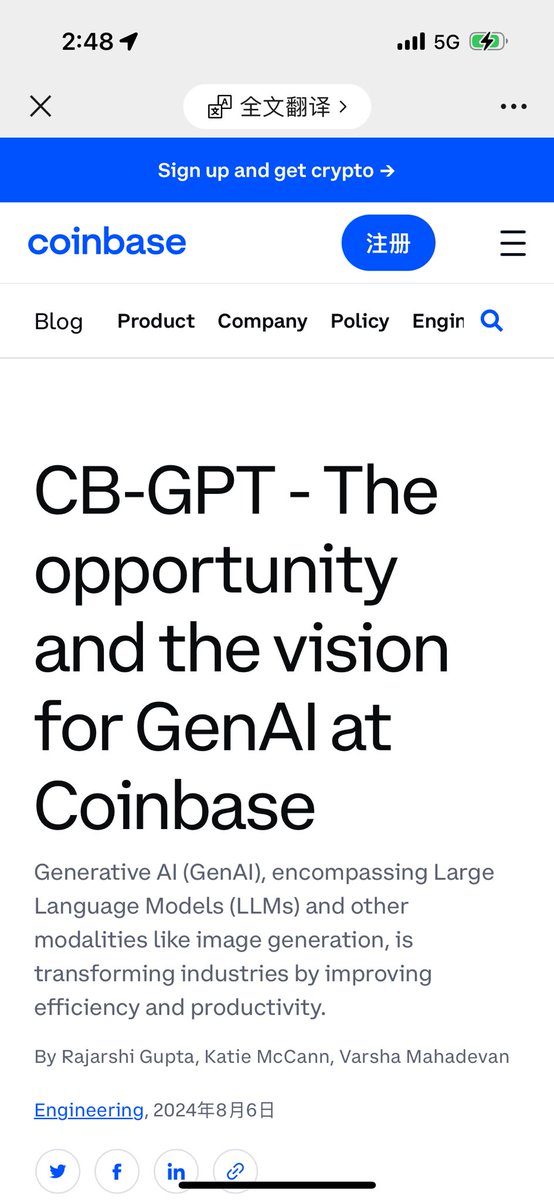

震撼!Coinbase推出CB-GPT,带来AI革命

---

这是什么?

Coinbase刚刚发布了他们的最新杀手锏——CB-GPT平台。这可不是普通的AI,它不仅能读能写,还能编程和画图,几乎无所不能!这张图片揭示了一个全新的未来:生成式AI(GenAI)即将颠覆我们熟悉的一切。

为什么重要?

Coinbase的CB-GPT平台将为用户提供个性化、情境化的支持。不管你是新手还是老手,从个人到机构投资者,CB-GPT都能为你量身定制解决方案。想象一下,你可以随时随地获得精准的投资建议,迅速处理复杂的数据分析,再也不用为决策犯愁。

震撼的未来

更恐怖的是,CB-GPT不仅帮助用户,还会大幅提高Coinbase员工的工作效率。这意味着什么?意味着Coinbase将以更快的速度推进创新,引领整个加密行业的发展。竞争对手们,要小心了!

结论

这不仅仅是一次技术升级,这是一次彻底的行业变革。CB-GPT将重新定义我们如何参与加密经济,如何工作,甚至如何生活。准备好迎接这个AI革命了吗?别眨眼,这只是开始!

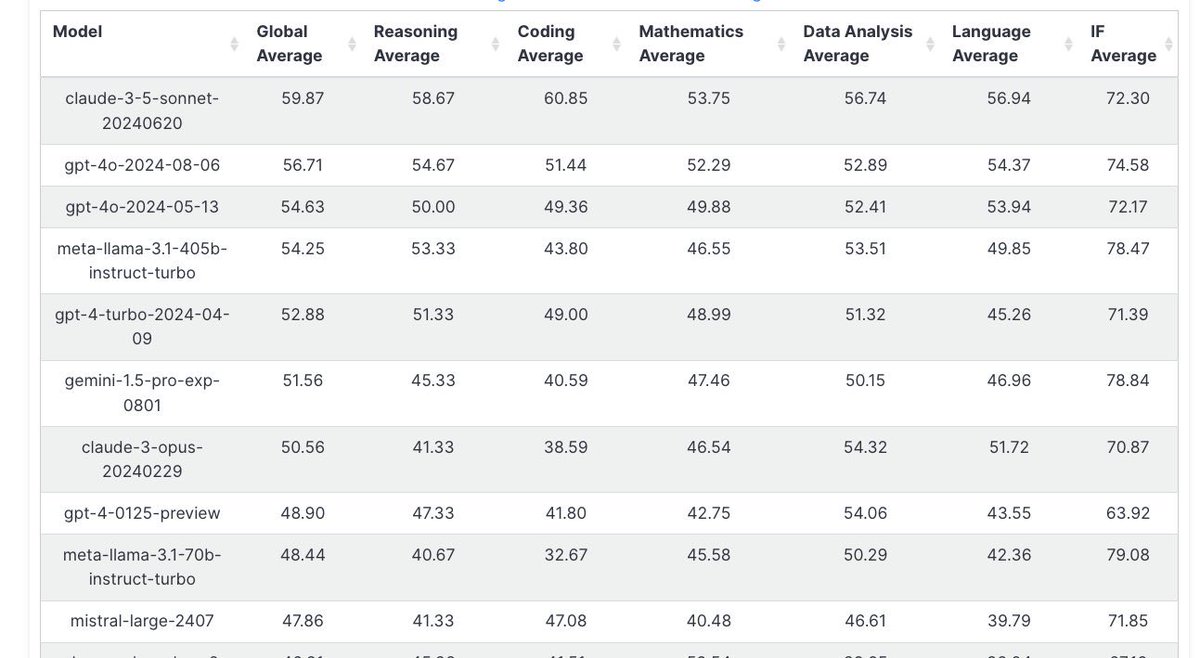

今天OAI悄悄发布了一个新模型——GPT-4o!这个新模型比之前的版本稍微好一些,而且价格便宜了50%!目前,它在Livebench的表现仅比Sonnet 3.5略差一点。

我猜测他们主要是想向大家展示,他们可以做得比Llama-3 405B和Sonnet 3.5更好、更便宜。在过去几个月里,他们的价格和性能一直落后于Anthropic,但现在他们开始慢慢赶上了。

尽管如此,他们仍然面临着巨大的压力,需要尽快发布GPT-5。说实话,我也不太清楚他们在等什么。

场景:

假设你是一位开发者,正在为一个新的聊天机器人项目寻找一个高性价比的AI模型。你听说了今天OAI发布的GPT-4o,它不仅性能更好,价格还便宜了一半。于是你决定试试看。

使用GPT-4o后,你发现它的文本理解和多模态推理能力明显优于之前使用的GPT-3.5 Turbo。你的项目进展顺利,成本也大大降低。你和团队都对这个新模型的表现非常满意,甚至考虑未来将更多项目转移到GPT-4o上。

使用最佳模型以适应具体用例

编码 - Sonnet 3.5

远远优于市面上的任何其他产品

搜索/信息 - GPT-4o

在信息总结方面表现出色

文档分析和理解 - GPT-4或GPT-4o

具备良好推理能力和优秀的RAG能力

写作 - Sonnet 3.5

有时过于简短,但需要一些引导和鼓励

图像生成 - Dall-E-3

我希望很快能转移到Flux

视频理解 - Gemini

这是我们发现Gemini表现非常稳定的一个领域

声音 - Eleven Labs

他们在选择合适的声音和语调方面做得相当不错

场景应用

1. 编码 - Sonnet 3.5:

场景:开发人员需要编写复杂的代码,Sonnet 3.5 提供了强大的编码能力,能够生成高效、准确的代码,显著提高开发效率。

2. 搜索/信息 - GPT-4o:

场景:研究人员需要快速获取并总结大量信息,GPT-4o 可以高效地整理和总结信息,帮助用户快速掌握关键信息。

3. 文档分析和理解 - GPT-4或GPT-4o:

场景:律师或研究员需要对大量文档进行分析和理解,GPT-4 或 GPT-4o 能够结合推理和RAG能力,提供深入的文档分析和理解支持。

4. 写作 - Sonnet 3.5:

场景:作家或记者需要撰写文章或报告,Sonnet 3.5 能够生成流畅的文字内容,但有时需要一些引导和细化,以确保内容充分和详细。

5. 图像生成 - Dall-E-3:

场景:设计师需要创建独特的视觉内容,Dall-E-3 提供了强大的图像生成能力,帮助设计师轻松创作出高质量的图像。

6. 视频理解 - Gemini:

场景:视频内容分析师需要对大量视频进行分析和理解,Gemini 在视频理解领域表现稳定,能够准确提取和理解视频中的重要信息。

7. 声音 - Eleven Labs:

场景:配音演员或音频工程师需要选择合适的声音和语调,Eleven Labs 提供了丰富的声音选项和调节能力,帮助用户找到最合适的声音效果。

通过这些最佳模型的使用,不同行业和领域的用户可以根据具体需求,选择最适合的模型来完成任务,显著提高工作效率和效果。

OpenAI的问题所在……

OpenAI的根本问题在于它迅速从一家高端的AGI(通用人工智能)研究公司转型为一家产品公司。

唯一能实现这种转型的方法是大幅度地从研究转向注重收入的生成。

这种文化和氛围的转变必然会引发紧张关系,早期加入的员工本来是为了专注于AGI研究使命,而现在却不得不将重心转移到成为标准公司所需的战术问题上。

最后,专注于类似SearchGPT这样的项目,如何与AGI目标相关尚不明确。正确的做法应该是直接朝着AGI方向前进,但他们选择了不这么做,现在正经历这一决定的后果。

OpenAI的根本问题在于它的使命发生了根本性的偏移。最初,OpenAI作为一个高端AGI研究公司吸引了大量顶尖人才,他们的目标是追求通用人工智能的终极目标。然而,随着时间的推移,OpenAI逐渐变成了一家专注于产品的公司,这种转变需要从纯粹的研究方向转向收入生成。

1. 文化冲突:这种转变带来了巨大的文化冲突。那些最初加入公司、抱有理想主义和科研热情的员工,发现自己现在不得不面对公司化运营所带来的日常战术问题。这种转变无疑会引发内部的不满和离职潮。

2. 战略迷失:OpenAI似乎在其发展战略上失去了方向。虽然公司宣称在致力于AGI的研究,但实际上却在开发像SearchGPT这样的产品。对于AGI的终极目标,这些产品的相关性和贡献尚不明确,导致了外界对其战略方向的质疑。

3. 决策后果:OpenAI的管理层选择了不直接追求AGI,而是分散注意力到其他商业化项目上。这种决策现在带来了后果:公司内部的科研氛围削弱,员工士气受挫,原有的AGI目标也因此受到影响。

综上所述,OpenAI的转型并未如预期般顺利,而是带来了内外部的诸多挑战。如何在维持公司盈利和商业化的同时,不偏离AGI的科研初衷,仍然是OpenAI需要深思的问题。

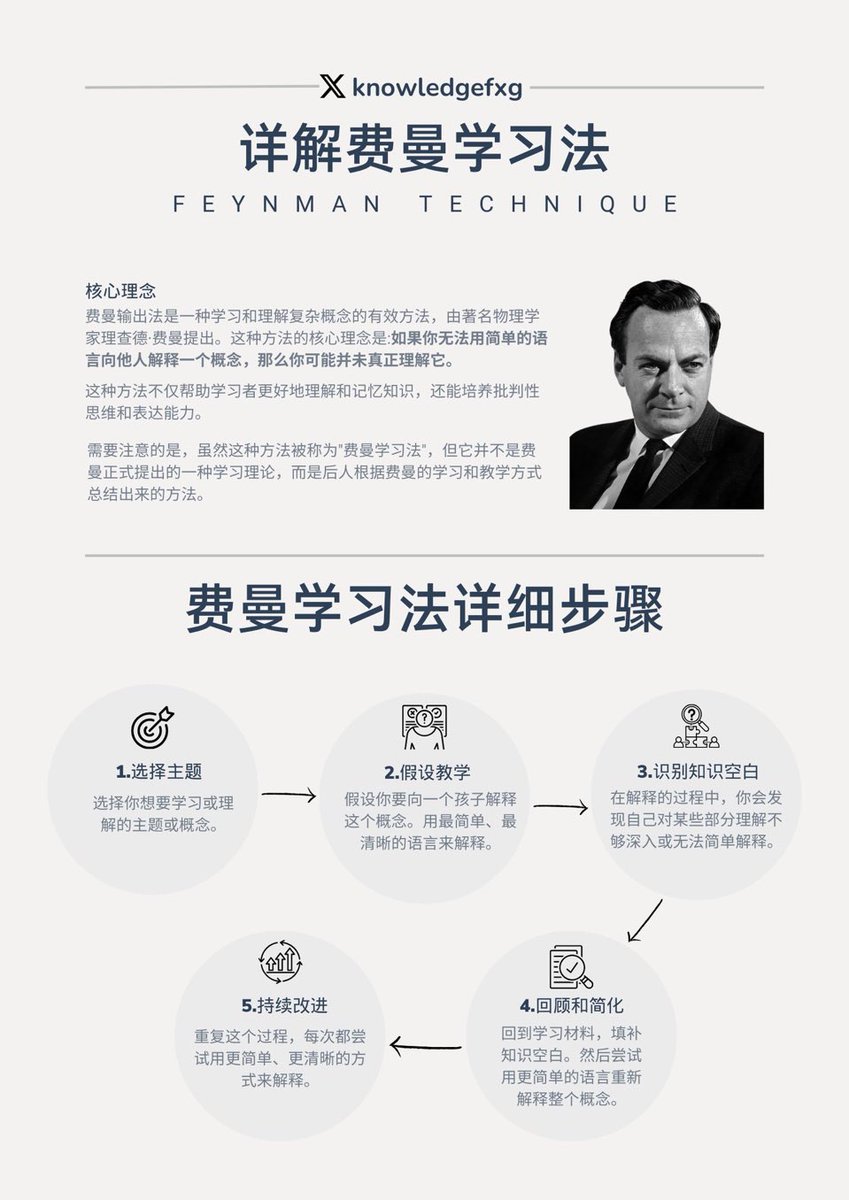

费曼学习法通过教授他人来加深自己对概念的理解,并通过分解和用自己的话解释概念来发现并改进理解中的缺陷。这样做可以加深记忆和理解。

简单来说:通过教别人和用自己的话解释来理解和记忆知识。 https://t.co/w81zl473My

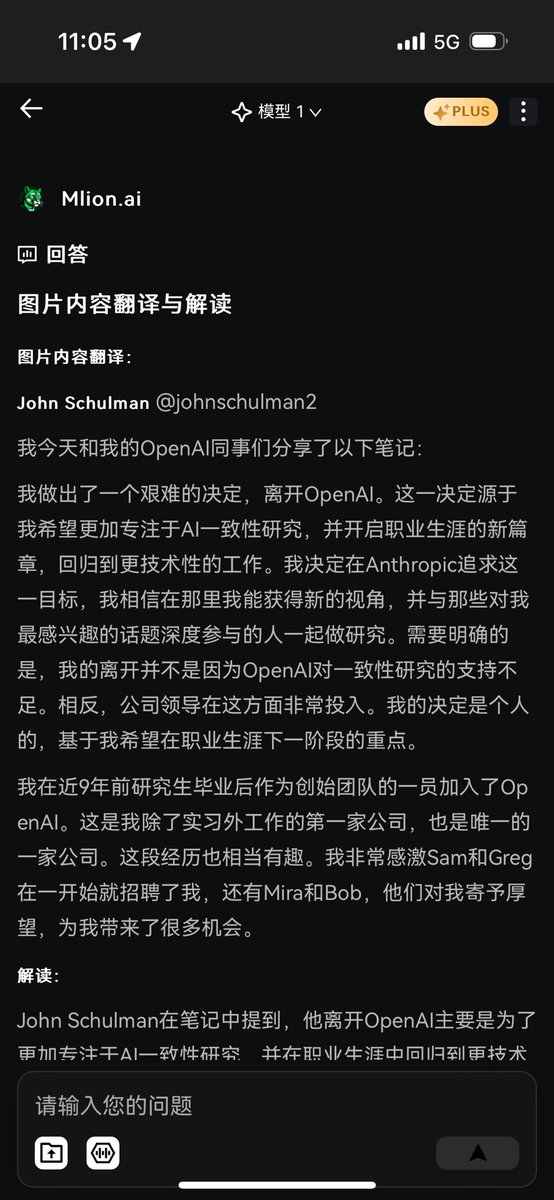

John Schulman在他的推文中宣布了一个重大的决定——离开OpenAI,选择加入Anthropic。他详细说明了自己做出这个决定的原因,并表达了对过去9年在OpenAI工作的感激之情。以下是对这条推文的详细解读及大胆猜测他离开的原因:

详细解读

1. 个人决定和动机:

Schulman表示,这次离开是一个困难的决定,主要出于他想要更加专注于AI一致性研究的愿望,并且想要开启职业生涯的新篇章,回归到更多的技术工作中。他提到,在Anthropic,他相信自己可以获得新的视角,并与深度投入一致性问题的同行们一起开展研究。

2. 对OpenAI的肯定:

他强调,离开的原因并不是因为OpenAI缺乏对一致性研究的支持。相反,公司领导层对这一领域的投入是非常坚定的。这表明他对OpenAI的工作环境和研究氛围是肯定的,只是他个人职业发展方向的调整。

3. 感恩和回顾:

Schulman对他在OpenAI的经历表示感激,回忆起自己作为创始团队成员加入公司的过程,并感谢Sam Altman、Greg Brockman等人的支持和信任。他特别提到,在OpenAI工作是非常有趣和充实的经历。

大胆猜测他离开的原因

1. 职业发展和个人兴趣:

John Schulman提到他想要更加专注于AI一致性研究,这表明他可能认为在Anthropic可以更好地实现这一目标。也许他在OpenAI的工作环境中感到技术研究的空间受到某种程度的限制,或者希望在一个新的环境中获得更多的灵感和突破。

2. 内部战略分歧:

尽管他强调离开不是因为缺乏支持,但不能排除他和OpenAI在研究方向或公司战略上存在一些分歧。例如,OpenAI近年来在商业化方面的迅速推进可能与他专注于技术研究的初衷有所冲突,导致他选择离开,寻找一个更加纯粹的研究环境。

3. Anthropic的吸引力:

Anthropic是OpenAI的主要竞争对手之一,并且在AI一致性和安全性方面有很强的研究团队。Schulman可能被Anthropic的研究氛围和团队吸引,认为在那里他可以更好地实现自己的研究目标和职业抱负。这种跳槽行为在科技行业并不罕见,特别是在竞争对手之间吸引顶尖人才时。

总结

据https://t.co/St5O59mmxt分析,John Schulman的离开可能是由于他对职业发展的重新思考,以及对AI一致性研究的强烈兴趣驱动。他在推文中表述的感谢和肯定表明他与OpenAI的关系并未因离职而恶化,这更可能是一次积极的职业转型。未来,Schulman在Anthropic的表现值得关注,他的离开也可能对OpenAI的研究方向产生一定影响。

据https://t.co/St5O59mmxt分析,OpenAI近日经历了重大人事变动,三位核心高管的离职或休假引起了广泛关注。这三位高管分别是Greg Brockman、John Schulman和Peter Deng。他们的离职或休假引发了对OpenAI内部动荡和未来发展方向的诸多猜测。

核心信息:

1. Greg Brockman长期休假:Greg Brockman是OpenAI的11名联合创始人之一,目前正在休假。他计划在延长假期后返回公司。

2. John Schulman跳槽到Anthropic:John Schulman是另一位联合创始人,他在OpenAI工作了9年,领导了大模型预后训练团队,最近接管了超级对齐安全团队。他选择离开OpenAI并加入竞争对手Anthropic,希望能够深入研究人工智能的一致性问题,即让人工智能与人类价值观相一致。

3. Peter Deng离职:Peter Deng是OpenAI的产品负责人,之前在Meta Platforms、Uber和Airtable等公司担任产品领导。他在OpenAI负责ChatGPT的产品工作,但目前已经离职。

深入分析:

这些变动发生在OpenAI业务快速发展、但管理层尚未完全稳定的时期。以下是一些可能的原因和大胆推测:

1. 内部管理结构调整:OpenAI在去年11月经历了Sam Altman被解雇并重新聘用的事件,之后管理层进行了重新梳理。然而,管理层的频繁变动可能导致内部不稳定,使得一些高管选择离开或休假。

2. 职业发展和个人选择:John Schulman在社交媒体上提到,他选择离开是为了更加深入地研究人工智能一致性问题,并开始职业生涯的新篇章。他希望在Anthropic能够获得新的视角,并与志同道合的人一起工作。这表明一些高管可能寻求新的挑战和发展机会。

3. 竞争压力:Anthropic是OpenAI的激烈竞争对手,吸引了包括John Schulman在内的多位重要人物。竞争对手的崛起可能对OpenAI构成压力,促使部分高管选择跳槽。

4. 公司战略和方向:OpenAI最近将另一位安全负责人Aleksander Madry重新分配到另一个职位,联合创始人Ilya Sutskever和Andrej Karpathy也先后离职并创办了自己的初创公司。这些变动可能反映了公司内部对战略和方向的不同看法,导致一些高管选择离开。

大胆推测:

OpenAI的这些人事变动可能暗示着公司内部存在战略分歧或管理矛盾。一些高管可能对公司的未来方向和管理方式不满,选择离开或休假以寻求更符合自己理念的环境。此外,竞争对手Anthropic的崛起也对OpenAI构成了一定威胁,吸引了部分高管跳槽。

总之,OpenAI的高管离职和休假事件反映了公司在快速发展中的挑战和压力。未来,如何稳定管理层、明确战略方向,将是OpenAI需要解决的关键问题。

The recent announcement by Greg Brockman, co-founder and president of OpenAI, about taking a sabbatical until the end of the year, coupled with the news of John Schulman and Peter Deng's departures, signals a significant shift within the organization.

This wave of high-level exits could indicate deeper underlying issues within OpenAI's leadership and strategic direction.

Firstly, the simultaneous departure of three key figures raises questions about internal dissatisfaction. Greg Brockman’s decision to take a break might reflect his need for a personal reset, but it could also hint at potential disagreements with the current management or board, including CEO Sam Altman. High-stress environments and differing visions often lead to such pivotal changes.

John Schulman’s move to Anthropic, a company founded by former OpenAI researchers, is particularly telling. Anthropic has positioned itself as a fierce competitor to OpenAI, focusing on creating safe and human-centered AI. Schulman's transition might suggest a stronger alignment with Anthropic’s values and approach to AI development. This move could be seen as a critique of OpenAI's current direction or culture.

Peter Deng's departure after a relatively short stint also raises eyebrows. Having joined from leading tech giants like Meta Platforms, Uber, and Airtable, Deng’s exit could indicate unmet expectations or misalignments with OpenAI’s strategic objectives or internal culture.

The exodus of such significant leaders can have a ripple effect, potentially affecting morale and sparking further departures. It may also prompt OpenAI to re-evaluate its strategic goals and management practices to retain top talent and maintain its competitive edge in the AI industry.

In conclusion, these developments suggest that OpenAI is at a crossroads. The organization might need to address internal conflicts and realign its vision to ensure the continued progress towards its mission of building safe AGI. The coming months will be crucial for OpenAI as it navigates this period of transition and potential upheaval.

🚀 Big news from @gdb taking a sabbatical until the end of the year! Is this signaling a major shift at OpenAI? Could his contract be ending? 🤔 Maybe they're prepping us for a new leadership transition? Possible rift with @sama or the board? Bold moves ahead! Exciting times for AI! 🌟 OpenAI AILeadership FutureOfAI

Greg Brockman的这条推特表明他将休假到今年年底,这是他自创立OpenAI以来首次放松的机会。这条推特可以有几种解读:

1. 休息和调整:这是他9年来第一次休息,这可能表明他需要时间来恢复精力和重新调整。对于领导者来说,这种休息可能是为了未来的更大挑战做准备。

2. 潜在的变化:他提到任务远未完成,暗示OpenAI仍有许多工作要做,但他个人需要时间休息。这可能意味着公司内部可能会有一些调整或他个人角色的转变。

3. 人事变动的可能性:虽然他没有明确表示将离开OpenAI,但在年底休假期满后,可能会有新的安排,或他可能会在新的角色中继续为OpenAI贡献力量。考虑到他的职位重要性,董事会和其他高层管理人员可能已经在准备应对这一变化。

4. 与Sam Altman及董事会的关系:Greg Brockman与Sam Altman或董事会之间是否存在潜在不合,我们无法确定。但这种情况在高层管理团队中并不罕见,尤其是在重要决策和公司未来方向上。

大胆猜测,这可能是他计划调整自己在OpenAI的角色,甚至可能离开公司的前兆。在年底,大家可能会习惯他不再是OpenAI的总裁,而是另有新任命